いいか、私は「画期的」AIモデル発表のニュースを、小さなデータセンターを埋め尽くすほど見てきた。次々と発表され、熱狂的なツイートが飛び交う。そして…静寂。だからDeepSeekがV4 ProとV4 Flashを発表した時、私が最初にチェックしたのはベンチマークではなかった。投資家向けIRページだ(ほとんどのAIスタートアップにとって、これはありがたいことに空っぽだが)。なぜなら、そこでこそ真実が語られていることが多いからだ。誰が実際に金儲けをしているのか、と。

そして今回、地政学的なひねりがある。DeepSeekは、 bless their hearts、NVIDIAという甘い蜜から離れようとしている。もっともだ。輸出規制は面倒だし、そもそもH100は最近のよく書かれたテックブログより希少だからな。そこで彼らはHuaweiのAscendチップとの互換性を謳っている。可愛いものだ。AscendはH100に遠く及ばないが、まあ、表明としては意味がある。独立性の表明だ。中国のAI完全自給への行進の表明だ。それが経済的に健全な戦略かどうかは、また別の話だが。

100万トークンと、祈り

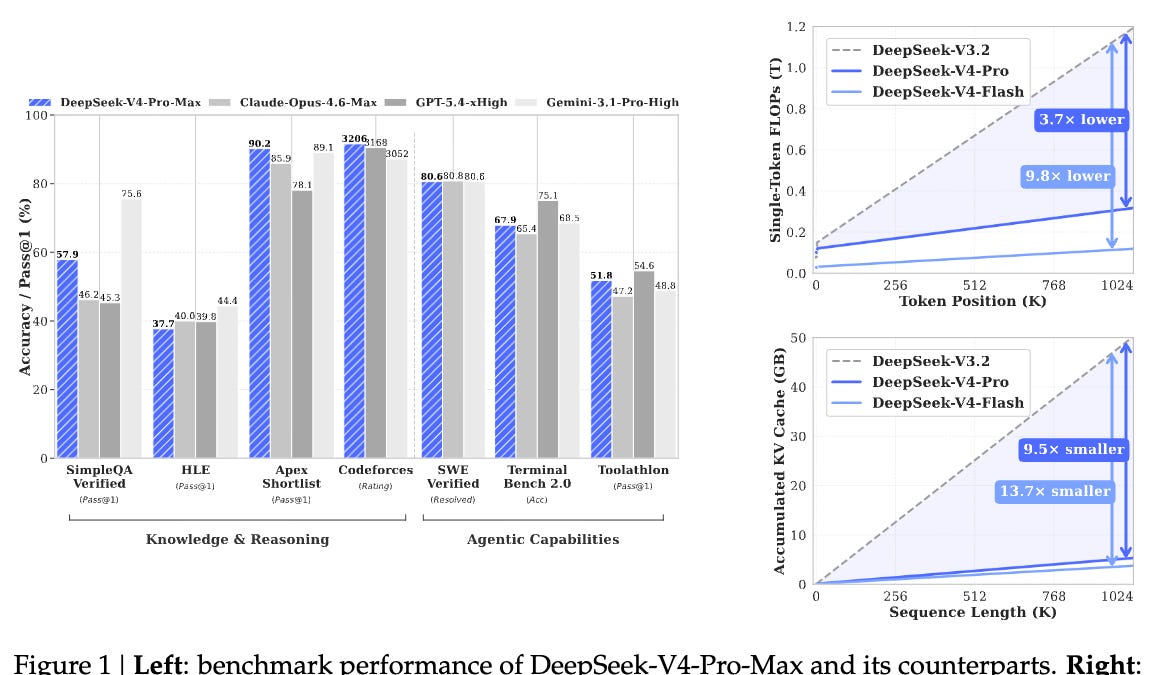

一番の目玉は? なんと100万トークンのコンテキストウィンドウだ。100万。トークン。数年前なら、平均的なチャットボットが扱えた量の約1000倍だ。彼らはこれを、Compressed Sparse Attention (CSA) と Heavily Compressed Attention (HCA) と呼ばれる、何かすごい新技術のおかげだと言っている。どうやら、これらが「驚異的に効率的」らしい。彼らはV3.2と比較して、FLOPsの27%、KVキャッシュメモリの10%で済むといった数字を並べている。もし本当なら、それは…すごいことだ。だが、問題はこうだ:効率は素晴らしい。だが、それが人々が「お金を払ってでも」使いたいと思えるより良い結果につながるのか?

そして、Base版とInstruct版の両方をリリースした。賢い。さらなるイテレーション、さらなる収益源への道を開く。だが、先走りすぎるのはよそう。技術レポート、学術的な巧妙さが詰まった58ページにこそ、真の栄養がある。Manifold Constrained Hyper-Connections (mHC) や Moonshot’s Muon といったものを論じている。印象的だ。…複雑に聞こえる。巨大で資金力のあるラボの外では、実際に再現するのが難しい種類の複雑さだ。これは進歩を民主化しているのか、それとも単に、より排他的にしているだけなのか?

これは単なるベンチマーク競争か?

いつものAIのロータリー、サブレットやTwitterでの囁きは、予想通り分かれている。V4 Proを、Kimi K2.6やClaude Sonnetクラスのモデルと肩を並べ、ベンチマークによってはOpusの領域に触れるかもしれない、と評価する者もいる。一方、GPT-5.xのような最先端モデルにはまだ一歩及ばない、と慎重な意見もある。そして、これが「民主化」なのか、それともごく一部の者しか大規模に構築・デプロイできないほど複雑なアーキテクチャを生み出しているのか、という議論もある。後者の方が、私にははるかに可能性が高いように思える。ファインチューニングや実行に莫大な計算能力を必要とするモデルは、これまでにもあったのだから。

だが、このV4 Proは間違いなく怪物だ。1.6兆パラメータで、490億がアクティブ。V4 Flashは、より扱いやすい2840億総パラメータ、130億アクティブ。どちらも驚異的な32兆トークンで学習されている。その規模は想像を絶する。そして、メモリ削減に関する技術的な主張?もしそれが精査に耐えれば、それは重大だ。

議論全体で繰り返される最も具体的な技術的主張:V4 Pro: 総パラメータ1.6T / アクティブ49B V4 Flash: 総パラメータ284B / アクティブ13B

いいか、最も巨大で、最も有能なモデルを構築する競争は続いている。それは常にそうだ。だが、真の問題は、パラメータがいくつあるか、どれだけのトークンを吸い込めるかではない。それは、それを取り巻くビジネスを実際に構築できるのが誰か、ということだ。誰がチェックを書いているのか?誰が、学術論文の引用以上の、真の価値を生み出す方法でこれらのものをデプロイしているのか?

なぜHuaweiへの転換が重要なのか(あるいはそうでないのか)

HuaweiのAscendチップへの転換は、私が言ったように、部屋の中の地政学的な象だ。DeepSeekにとっては、米国制裁と輸出制限という締め付けを回避するための戦略的動きだ。これは、中国が自国のAIインフラにさらに注力するという広範なトレンドを示している。彼らは自社のファウンドリ、自社のチップ設計、自社のAIスタックを構築している。これは単なるDeepSeek V4 Proの問題ではなく、技術的主権という長期的なゲームなのだ。

だが、Ascendハードウェアは、これほど大規模なモデルを効率的にサポートするほど成熟しているのか?Huaweiのソフトウェアスタック、例えばCANN(Compute, Aggregate, and NPU)プラットフォームは、本当にCUDAと競争できるのか?私の勘では、まだだ。最先端では無理だ。それは妥協だ。戦略的な理由からは、おそらく必要な妥協だが、それでも妥協だ。それは、V4 Proが紙面上では技術的に印象的であっても、その実用的なデプロイメントとパフォーマンスは、特にNVIDIAのH100やBlackwellで可能なものと比較して、基盤となるハードウェアによって制限される可能性があることを意味する。

だから、DeepSeekが技術的飛躍を祝っている間、私は判断を保留している。印象的なスペックはある。ロングコンテキストは真の進歩だ。だが、真の試練は、採用、収益化、そしてこの能力の飛躍が、実際の、具体的なリターンに翻訳できるかどうかだろう。私の予想では、今のところ多くの研究論文と、非常にニッチなデプロイメントだろう。AIのゴールドラッシュは続いているが、権利主張者たちはますます巧妙になっている。

🧬 関連インサイト

- もっと読む: 自己改善AI?いや、君がその脳を進化させているのだ

- もっと読む: 軌道上データセンター:AIの地球のエネルギー束縛からの脱出