Видали мы достаточно анонсов «прорывных» AI-моделей, чтобы заполнить небольшой дата-центр. Они выходят, порождают шквал восторженных твитов, а потом… тишина. Так что, когда DeepSeek объявили о V4 Pro и V4 Flash, первым делом я полез не на страницу с бенчмарками, а на страницу для инвесторов (которая, к счастью, у большинства таких AI-стартапов пустует). Ведь именно там обычно кроется настоящая история. Кто здесь вообще зарабатывает?

И тут возникает геополитический поворот. DeepSeek, с их благими намерениями, пытаются слезть с «молока» NVIDIA. Логично. Экспортные ограничения — та ещё головная боль, да и H100, честно говоря, сейчас встречаются реже, чем хорошо написанный технический блог. Поэтому они заявляют о совместимости с чипами Huawei Ascend. Мило. Ascend всё ещё на далёкой второй позиции после H100, но, знаете, это заявление. Это про независимость. Это про стремление Китая к полной самодостаточности в сфере AI. А вот насколько это экономически оправдано — вопрос уже другой.

1 миллион токенов и надежда

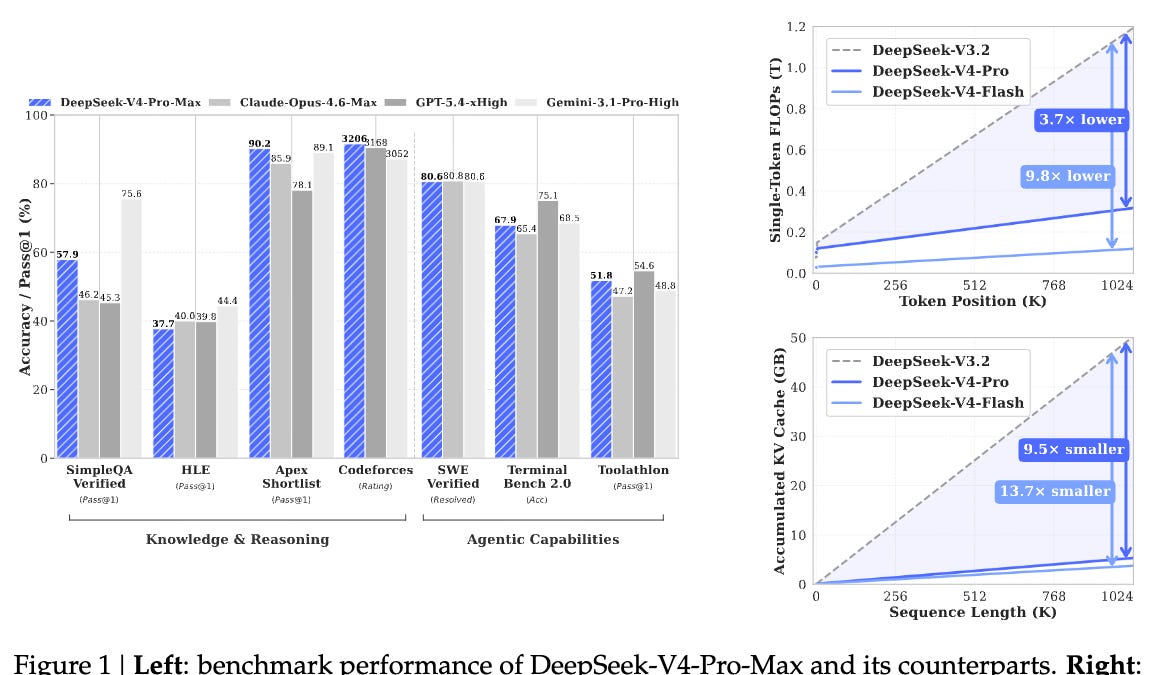

Главная новость? Контекстное окно в 1 миллион токенов. Один. Миллион. Токенов. Это примерно в тысячу раз больше, чем мог обработать среднестатистический чат-бот пару лет назад. Они утверждают, что это стало возможным благодаря некой крутой новой технологии, названной Compressed Sparse Attention (CSA) и Heavily Compressed Attention (HCA). Якобы, это делает всё «НЕВЕРОЯТНО эффективным». Они оперируют такими цифрами, как 27% FLOPs и 10% памяти KV-кэша по сравнению с V3.2. Если это правда, то… много. Но вот в чём загвоздка: эффективность — это хорошо, но приводит ли она к лучшим результатам, за которые люди заплатят?

К тому же, они выпустили и Base, и Instruct версии. Умный ход. Это закладывает основу для дальнейших итераций, новых потенциальных источников дохода. Но давайте не будем забегать вперёд. Технический отчёт, плотные 58 страниц академического волшебства, — вот где настоящая суть. Там говорят о таких вещах, как Manifold Constrained Hyper-Connections (mHC) и Moonshot’s Muon. Звучит впечатляюще. Звучит… сложно. Настолько сложно, что любому вне крупной, хорошо финансируемой лаборатории будет трудно это реально воспроизвести. Так это демократизация прогресса, или просто повышение его эксклюзивности?

Это просто очередная гонка бенчмарков?

Шум в обычных AI-тусовках на сабреддитах и в Твиттерах предсказуемо разделился. Одни считают V4 Pro достойным конкурентом, идущим вровень с Kimi K2.6 и моделями класса Claude Sonnet, а может, и достигающим уровня Opus, в зависимости от бенчмарка. Другие настроены более осторожно, отмечая, что модель всё ещё отстаёт от абсолютных передовых разработок вроде GPT-5.x. А ещё есть вся эта дискуссия о том, «демократизирует» ли это прогресс, или создаёт архитектуру настолько сложную, что лишь немногие смогут её реально построить и развернуть в масштабе. Последнее мне кажется гораздо более вероятным. Мы уже проходили это с моделями, требующими абсурдного количества вычислительных ресурсов для дообучения или работы.

Но V4 Pro — это, без сомнения, монстр. 1.6 триллиона параметров, из которых 49 миллиардов активны. V4 Flash — более управляемые 284 миллиарда общих и 13 миллиардов активных. Обе обучены на ошеломляющих 32 триллионах токенов. Масштаб просто поражает. И технические заявления о снижении потребления памяти? Если они выдержат проверку, это значительный прорыв.

Самые конкретные технические утверждения, повторяющиеся в обсуждениях: Две модели V4 Pro: 1.6T общих параметров / 49B активных V4 Flash: 284B общих / 13B активных

Смотрите, гонка за самой большой и мощной моделью идёт. Так было всегда. Но главный вопрос не в том, сколько у вас параметров или сколько токенов вы можете «всосать». Вопрос в том, кто сможет построить вокруг этого бизнес. Кто даёт деньги? Кто разворачивает всё это так, чтобы генерировать реальную ценность, а не просто цитаты для научных статей?

Почему поворот к Huawei имеет значение (возможно)

Этот поворот к чипам Huawei Ascend — как я уже говорил, геополитический слон в комнате. Для DeepSeek это стратегический ход, чтобы избежать «удушения» санкциями США и экспортными ограничениями. Это сигнализирует о более широкой тенденции Китая к укреплению собственной AI-инфраструктуры. Они строят свои фабрики, собственные чипы, собственные AI-стеки. Это не просто про DeepSeek V4 Pro; это про долгосрочную игру технологического суверенитета.

Но достаточно ли зрелое оборудование Ascend, чтобы эффективно поддерживать модели такого масштаба? Сможет ли программный стек Huawei, такой как их платформа CANN (Compute, Aggregate, and NPU), действительно конкурировать с CUDA? Моя интуиция подсказывает, что пока нет, не на самом передовом уровне. Это компромисс. Возможно, необходимый по стратегическим соображениям, но всё же компромисс. Это означает, что, хотя V4 Pro может быть технически впечатляющей на бумаге, её практическое развёртывание и производительность могут быть ограничены базовым оборудованием, особенно по сравнению с тем, что возможно на H100 или Blackwell от NVIDIA.

Так что, пока DeepSeek празднует свой технологический скачок, я воздержусь от окончательных выводов. Впечатляющие характеристики присутствуют. Длинный контекст — это настоящий шаг вперёд. Но настоящим испытанием станут принятие, монетизация и то, сможет ли этот скачок в возможностях трансформироваться в реальную, ощутимую прибыль. Мои деньги на то, что пока это будет много исследовательских статей и очень нишевое развёртывание. AI-золотая лихорадка продолжается, но охотники за золотом становятся всё хитрее.

🧬 Связанные инсайты

- Читайте также: AI, улучшающий себя сам? Нет, это вы развиваете его мозг

- Читайте также: Орбитальные дата-центры: AI покидает земные энергетические оковы