Bakın, küçük bir veri merkezini dolduracak kadar ‘çığır açan’ yapay zeka modeli duyurusu gördüm. Çıkıyorlar, nefes nefese tweetler havada uçuşuyor ve sonra… sessizlik. Yani DeepSeek V4 Pro ve V4 Flash’ı duyurduğunda, ilk baktığım şey kıyaslamalar değildi; yatırımcı ilişkileri sayfasına baktım (ki çoğu yapay zeka girişimi için bu nimet gibi boş). Çünkü hikayenin asıl kısmı genelde orada yatıyor. Burada gerçekten para kazanan kim?

Ve bu sefer, işin içinde jeopolitik bir bükülme var. DeepSeek, kalpleri onlarla birlikte, NVIDIA’nın memesinden ayrılmaya çalışıyor. Mantıklı. İhracat kontrolleri başa bela ve açıkçası, H100’ler bugünlerde iyi yazılmış bir teknoloji blogundan daha nadir bulunuyor. Bu yüzden, Huawei’nin Ascend çipleriyle uyumluluğu övüyorlar. Sevimli. Ascend’ler hala H100’lerin çok gerisinde olsa da, sonuçta bir gösterge. Bu bağımsızlık demek. Bu, Çin’in tam yapay zeka kendi kendine yeterliliğe doğru ilerlemesi demek. Ekonomik olarak sağlam bir strateji olup olmadığı ise bambaşka bir soru.

1 Milyon Token ve Bir Dua

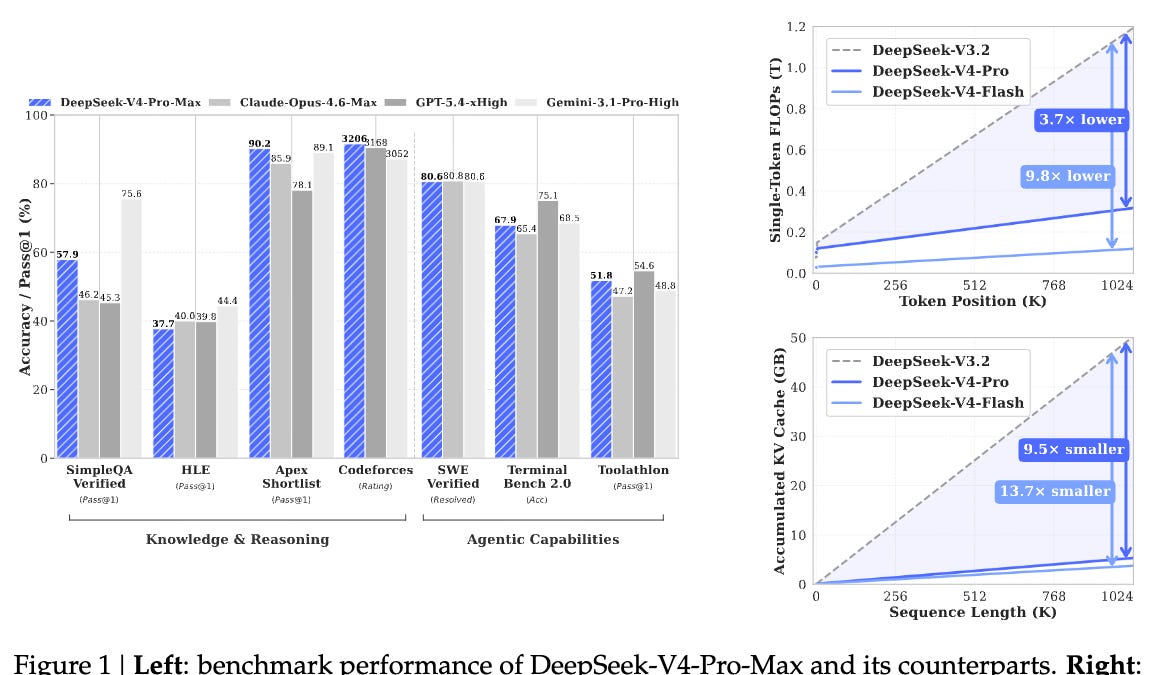

Manşet çeken şey ne mi? Tam 1 milyon token’lık bir bağlam penceresi. Bir. Milyon. Token. Bu, ortalama bir sohbet robotunun birkaç yıl önce işleyebileceğinden kabaca bin kat daha fazla. Bunun, Sıkıştırılmış Seyrek Dikkat (CSA) ve Ağır Sıkıştırılmış Dikkat (HCA) adını verdikleri bazı süslü yeni teknoloji sayesinde olduğunu iddia ediyorlar. Görünüşe göre işleri “İNANILMAZ derecede verimli” hale getiriyor. V3.2’ye kıyasla %27 FLOPs ve %10 KV önbellek belleği gibi rakamlar kullanıyorlar. Eğer doğruysa, bu… çok şey demek. Ama işin aslı şu: verimlilik harika, ama bu, insanların para ödeyeceği daha iyi sonuçlara dönüşüyor mu?

Hem Temel (Base) hem de Talimatlı (Instruct) sürümlerini yayınladılar. Akıllıca. Daha fazla yineleme, daha fazla potansiyel gelir akışı için zemin hazırlıyor. Ama acele etmeyelim. Teknik rapor, akademik sihirbazlığın yoğun 58 sayfası, asıl etin olduğu yer. Manifold Kısıtlı Hiper-Bağlantılar (mHC) ve Moonshot’un Muon’u gibi şeylerden bahsediyorlar. Etkileyici görünüyor. Karmaşık görünüyor. Büyük, iyi finanse edilmiş bir laboratuvar dışındaki herkesin gerçekten kopyalamasını zorlaştıran türden bir karmaşıklık. Yani, bu ilerlemeyi mi demokratikleştiriyor, yoksa sadece daha mı özel hale getiriyor?

Bu Sadece Bir Kıyaslama Yarışı mı?

Sıradan yapay zeka dönen dolabının alt dizileri ve Twitter’daki sohbetler tahmin edileceği gibi ikiye bölünmüş durumda. Bazı arkadaşlar V4 Pro’yu Kimi K2.6 ve Claude Sonnet sınıfı modellerle başa baş, hatta kıyaslamaya bağlı olarak Opus alanına dokunan sağlam bir yarışmacı olarak görüyor. Diğerleri daha temkinli, GPT-5.x gibi en son modellerin hala bir adım gerisinde olduğunu belirtiyor. Ve sonra, bunun ilerlemeyi “demokratikleştirip” demokratikleştirmediği veya sadece seçkin birkaç kişinin gerçekten ölçekte inşa edip dağıtabileceği kadar karmaşık bir mimari yaratıp yaratmadığı tartışması var. Bana ikincisi çok daha olası görünüyor. İnce ayar yapmak veya çalıştırmak için absürt miktarda işlem gücü gerektiren modellerle daha önce de buralardaydık.

Ama bu V4 Pro bir canavar, şüphesiz. 1.6 trilyon parametre, 49 milyarı aktif. V4 Flash daha yönetilebilir 284 milyar toplam, 13 milyar aktif. Her ikisi de şaşırtıcı derecede 32 trilyon token üzerinde eğitilmiş. Sadece ölçek akıl almaz. Ve bellek azaltma hakkındaki teknik iddialar? İncelendiğinde geçerliyse, bu önemli.

Tartışma boyunca tekrarlanan en somut teknik iddialar: İki model V4 Pro: 1.6T toplam parametre / 49B aktif V4 Flash: 284B toplam / 13B aktif

Bakın, en büyük, en yetenekli modeli inşa etme yarışı devam ediyor. Hep böyleydi. Ama asıl soru kaç parametrenizin olduğu veya kaç token’ı yutabildiğiniz değil. Asıl soru, etrafında gerçekten bir iş kurabilen kim? Çekleri kim yazıyor? Akademik makale atıflarından başka gerçek değer üreten şekillerde bunları kim dağıtıyor?

Huawei Pivotu Neden Önemli (Belki de)

Bu Huawei’nin Ascend çiplerine dönüşü, dediğim gibi, odadaki jeopolitik fil. DeepSeek için bu, ABD yaptırımlarının ve ihracat kısıtlamalarının boğucu etkisinden kaçmak için stratejik bir hamle. Çin’in kendi yapay zeka altyapısına daha fazla yatırım yapma eğilimini gösteriyor. Kendi dökümhanelerini, kendi çip tasarımlarını, kendi yapay zeka yığınlarını inşa ediyorlar. Bu sadece DeepSeek V4 Pro ile ilgili değil; bu teknolojik egemenliğin uzun vadeli oyunuyla ilgili.

Ancak Ascend donanımı bu ölçekteki modelleri verimli bir şekilde destekleyecek kadar olgun mu? Huawei’nin CANN (Compute, Aggregate, and NPU) platformu gibi yazılım yığını gerçekten CUDA ile rekabet edebilir mi? İçgüdülerim henüz değil, en uç noktada değil diyor. Bu bir uzlaşma. Stratejik nedenler için belki gerekli bir uzlaşma, ama yine de bir uzlaşma. Bu, V4 Pro kağıt üzerinde teknik olarak etkileyici olsa da, pratik dağıtımı ve performansının, özellikle NVIDIA’nın H100’leri veya Blackwell’leriyle karşılaştırıldığında, altta yatan donanım tarafından sınırlanabileceği anlamına geliyor.

Yani, DeepSeek teknolojik sıçramasını kutlarken, ben yargımı saklı tutuyorum. Etkileyici özellikler orada. Uzun bağlam gerçek bir adımdır. Ancak asıl test benimsemesi, paraya dönüştürülmesi ve bu yetenek sıçramasının gerçek, somut geri dönüşlere dönüşüp dönüşemeyeceği olacaktır. Benim param, şimdilik bol araştırma makalesi ve çok niş bir dağıtım üzerine. Yapay zeka altın hücumu devam ediyor, ancak hak iddia edenler daha sofistike hale geliyor.

🧬 İlgili İçgörüler

- Daha Fazla Okuyun: Kendi Kendini Geliştiren Yapay Zeka mı? Hayır, Beynini Evrimleştiren Sizsiniz

- Daha Fazla Okuyun: Yörünge Veri Merkezleri: Yapay Zekanın Dünya Enerji Zincirlerinden Kurtuluşu