솔직히 말해, 작은 데이터센터 하나는 채우고도 남을 만큼 ‘혁신적’이라는 AI 모델 발표를 수도 없이 봤습니다. 모델이 나오고, 숨 막히는 트윗이 쏟아지다가… 결국엔 조용해집니다. 그래서 딥씨크가 V4 프로와 V4 플래시를 발표했을 때, 가장 먼저 확인한 건 벤치마크가 아니었습니다. 바로 투자자 관계 페이지였죠 (이런 AI 스타트업 대부분은 다행히도 비어있습니다). 보통 진짜 이야기는 거기서 나오니까요. 도대체 누가 여기서 돈을 벌고 있는 걸까요?

이번엔 지정학적 복병까지 등장했습니다. 딥씨크가 애써(?) 엔비디아 의존도에서 벗어나려 하고 있다는 점이 흥미롭습니다. 이해는 갑니다. 수출 통제는 골치 아프고, 솔직히 요즘 H100은 제대로 된 테크 블로그 글보다 보기 힘들 정도니까요. 그래서 화웨이 Ascend 칩과의 호환성을 자랑하고 있습니다. 귀엽죠. Ascend 칩은 여전히 H100에 비하면 한참 먼 후발 주자지만, 어쨌든 ‘우리는 독립적’이라는 메시지를 던지는 겁니다. 중국의 AI 자립 행보를 보여주는 거죠. 이게 경제적으로 타당한 전략인지는 별개의 문제입니다.

100만 토큰, 그리고 약간의 기도

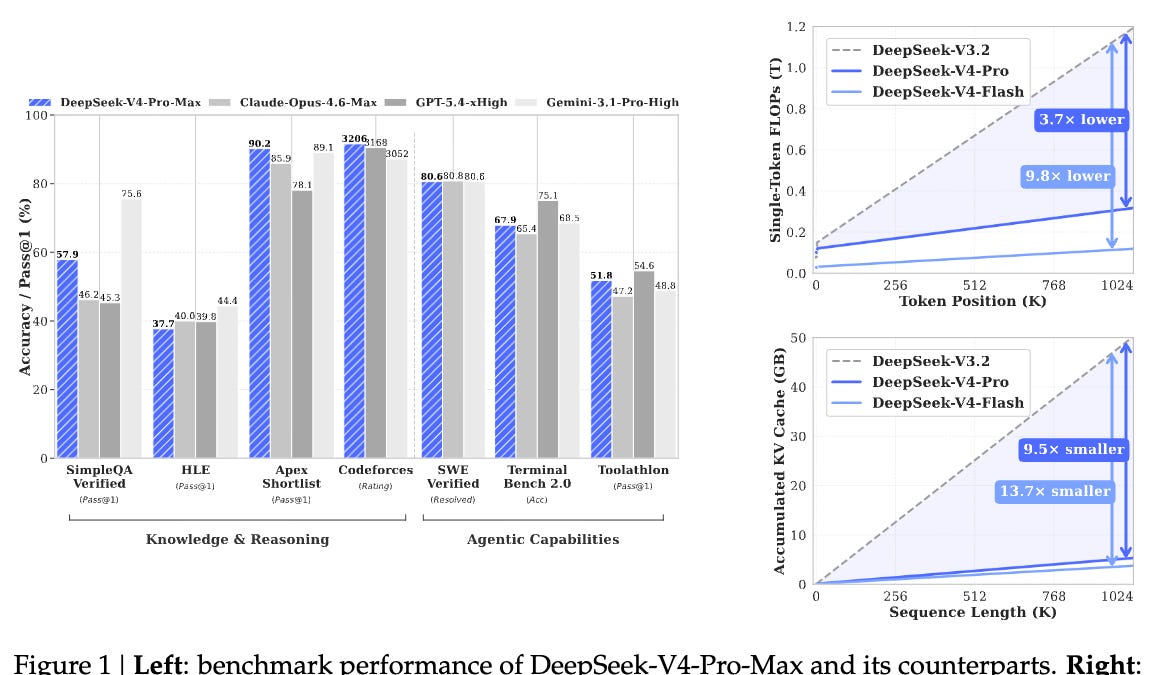

가장 눈길을 끄는 건? 무려 100만 토큰의 컨텍스트 길이입니다. 100만! 불과 몇 년 전 평균적인 챗봇이 처리할 수 있었던 것의 천 배에 달합니다. 딥씨크는 이를 ‘압축 희소 어텐션(Compressed Sparse Attention, CSA)’과 ‘집약 압축 어텐션(Heavily Compressed Attention, HCA)’이라는 신기술 덕분이라고 주장합니다. 덕분에 ‘엄청나게 효율적’이라고 하네요. V3.2 대비 FLOPs의 27%, KV 캐시 메모리의 10%만 사용한다고 합니다. 이게 사실이라면… 대단한 겁니다. 하지만 핵심은 이거죠. 효율성이 좋아도, 사람들이 ‘돈을 내고’ 쓸 만큼 결과가 더 나아지는 걸까요?

기본(Base) 버전과 명령어(Instruct) 버전을 모두 출시했습니다. 현명한 전략입니다. 더 많은 반복 작업, 더 많은 잠재적 수익원을 위한 발판을 마련한 셈이죠. 하지만 너무 앞서나가진 맙시다. 58페이지에 달하는 학술적인 내용으로 가득 찬 기술 보고서가 진짜 중요한 부분을 담고 있습니다. ‘다양체 제약 하이퍼 연결(Manifold Constrained Hyper-Connections, mHC)’이니, ‘문샷의 뮤온(Moonshot’s Muon)’이니 하는 내용이 나오죠. 멋져 보입니다. 복잡해 보입니다. 거대한 자금이 투입된 연구실 밖에서는 실제로 구현하기 어려운 그런 복잡함 말입니다. 결국, 이게 기술 발전을 민주화하는 걸까요, 아니면 더 배타적으로 만드는 걸까요?

또 다른 벤치마크 경쟁인가?

평소 AI 관련 서브레딧과 트위터에서 들려오는 반응은 예측대로 엇갈립니다. 일부는 V4 프로를 Kimi K2.6이나 Claude Sonnet급 모델과 동등하거나, 벤치마크에 따라 Opus급에 근접하는 강력한 경쟁자로 평가합니다. 반면, GPT-5.x 같은 최전선 모델에는 아직 한 걸음 뒤처져 있다는 신중론도 있습니다. 그리고 이게 ‘민주화’하는 발전인지, 아니면 소수만이 대규모로 구축하고 배포할 수 있는 너무 복잡한 아키텍처를 만드는 건지에 대한 논쟁도 있습니다. 후자가 제겐 훨씬 더 가능성 높아 보입니다. 파인튜닝이나 실행에 엄청난 컴퓨팅 자원을 요구하는 모델들을 우리는 이미 여러 번 봐왔습니다.

하지만 이 V4 프로는 분명 강력합니다. 1.6조 개의 총 파라미터 중 490억 개가 활성 상태입니다. V4 플래시는 총 2,840억 개, 130억 개가 활성 상태로 더 관리하기 쉬운 규모입니다. 두 모델 모두 무려 32조 토큰으로 학습되었습니다. 그 규모만으로도 숨이 막힐 정도입니다. 메모리 감소에 대한 기술적 주장들은 어떻고요? 만약 검증된다면, 상당한 발전입니다.

논의 전반에 걸쳐 반복되는 가장 구체적인 기술적 주장: 두 모델: V4 프로: 1.6조 개 총 파라미터 / 490억 개 활성 V4 플래시: 2,840억 개 총 파라미터 / 130억 개 활성

크고 강력한 모델을 만들기 위한 경쟁은 치열합니다. 언제나 그랬죠. 하지만 진짜 질문은 파라미터 수가 얼마나 많거나, 토큰을 얼마나 많이 빨아들일 수 있느냐가 아닙니다. 핵심은 그걸 기반으로 비즈니스를 구축할 수 있느냐입니다. 누가 돈을 내고 있나요? 누가 실제 가치를 창출하는 방식으로 이 모델들을 배포하고 있나요? 단순한 학술 논문 인용을 넘어서 말입니다.

화웨이 전환이 중요한 이유 (아마도)

화웨이 Ascend 칩으로의 전환은 제가 앞서 말했듯이, 지정학적 문제의 핵심입니다. 딥씨크에게는 미국의 제재와 수출 규제의 족쇄를 피하기 위한 전략적 움직임입니다. 이는 중국이 자체 AI 인프라에 더욱 집중하는 광범위한 추세를 보여줍니다. 그들은 자체 파운드리, 칩 설계, AI 스택을 구축하고 있습니다. 이건 단순히 DeepSeek V4 프로만의 문제가 아니라, 기술 주권 확보를 위한 장기적인 게임입니다.

하지만 Ascend 하드웨어가 이 규모의 모델을 효율적으로 지원할 만큼 성숙했을까요? 화웨이의 CANN(Compute, Aggregate, and NPU)과 같은 소프트웨어 스택이 진정으로 CUDA와 경쟁할 수 있을까요? 제 직감으로는 아직, 최첨단에서는 아니라고 봅니다. 이건 타협입니다. 전략적인 이유 때문에 필요할 수 있는 타협이지만, 타협은 타협입니다. 이는 V4 프로가 기술적으로는 인상적일지라도, 실제 배포 및 성능은 언더라이잉 하드웨어에 의해 제한될 수 있음을 의미합니다. 특히 엔비디아의 H100이나 Blackwell에서 가능한 것과 비교했을 때 말이죠.

그래서 딥씨크가 기술적 도약을 자축하고 있을 때, 저는 일단 관망할 생각입니다. 인상적인 사양은 분명히 있습니다. 긴 컨텍스트 또한 분명한 진전입니다. 하지만 진정한 시험대는 채택, 수익화, 그리고 이러한 기능 향상이 실제 가시적인 수익으로 이어질 수 있는지 여부가 될 것입니다. 제 생각에는 당분간은 수많은 연구 논문과 매우 제한적인 배포에 그칠 가능성이 높습니다. AI 골드러시는 계속되겠지만, 땅꾼들은 점점 더 정교해지고 있습니다.