最後に、自分のノートPCが最先端のAI研究プラットフォームだと意識したのはいつだろうか? おそらく、一度も。それなのに、今、我々はここにいる。かつては巨大なサーバーファームとクラウドの巨人たちの専売特許だった人工知能の領域が、分裂し始めているのだ。GoogleのGemma 4やMetaのOpenclawといったイノベーションのおかげで、AIは民主化され、断片化し、そして君個人のマシンに降り立っている。これは単なる利便性の問題ではない。我々がAIとどのように関わり、開発していくかという、地殻変動とも言える変化だ。

長らく、大規模言語モデル(LLM)を巡る議論は、ペタバイト級のデータと数十億のパラメータでモデルを学習させる巨大企業に独占されてきた。これには、大多数の開発者、研究者、さらには好奇心旺盛な個人には手が届かないインフラが必要だった。コスト、複雑さ、そして純粋な計算能力の暴力とも言える要求は、アクセスを仲介され、管理され、そして率直に言って高価なものにしていた。

だが、ゲームは変わりつつある。しかも、猛烈なスピードで。

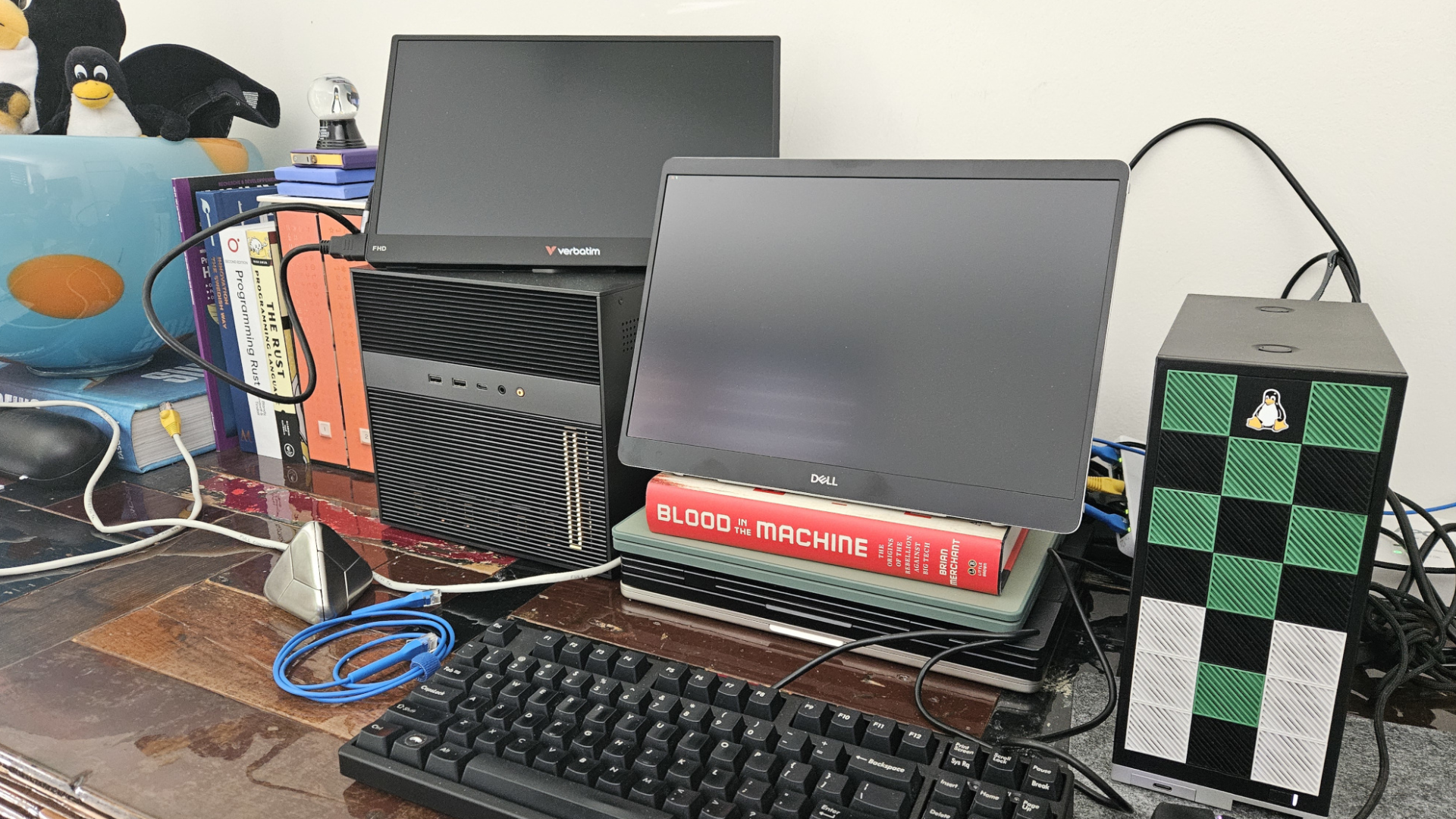

Gemma 4は、Googleの軽量で最先端なオープンモデル群であり、その最たる例だ。Geminiモデルの背後にあるのと同じ研究と技術で構築されたGemmaは、高性能であると同時にアクセスしやすいように設計されている。これは、テキスト生成、要約、質疑応答といった高度なAIタスクを、そこそこのGPUを搭載したラップトップやデスクトップで直接実行できることを意味する。常時インターネット接続は不要、クエリごとにAPI料金を払う必要もない。純粋な処理能力が、君の指先にあるのだ。

そして、Openclawがある。MetaのLlamaシリーズはオープンソースAIにおいて重要な存在だが、ここで注目すべきは、これらのモデルをローカルデプロイメントにより一層適合させることだ。その推進力は最適化、つまり限られたハードウェアからより多くのパワーを引き出すことにある。これは単に、学習済みモデルをコンシューマー向けグラフィックスカードに載せるだけではない。我々が既に所有しているハードウェアで、これらの複雑なニューラルネットワークが効率的に動作するようにするアーキテクチャ上のイノベーションなのだ。

なぜAIをローカルで実行することが重要なのか?

このローカルAI革命がもたらす影響は計り知れない。第一に、プライバシーの観点から絶大なメリットがある。機密データ、あるいは単なる会話パターンが、リモートサーバーで処理されるためにマシンを離れる必要がなくなれば、情報漏洩や不正アクセスのリスクは劇的に低下する。考えてみてほしい。君の個人的なメモ、独自のコードスニペット、あるいは単なるブレインストーミングのセッションも、それが企業の学習データになったり、ハッカーのデータベースに流出したりする心配なく、AIに投入できるのだ。

第二に、これはイノベーションを民主化する。巨額のクラウドコンピューティング予算を捻出できない研究者たちは、かつては不可能だった方法で、既存モデルを実験、改良、そして拡張できるようになる。小規模なスタートアップは、クラウドインフラの法外な初期費用なしに、特化したAIツールを開発できる。そして、常に境界線を押し広げてきたホビイストたち――いじくり回すのが好きな連中や好奇心旺盛な頭脳たち――は、かつてのプロラボに匹敵する遊び場を手に入れたのだ。

イテレーションの速度を考えてみてほしい。クラウドAPIの応答を待っていると、テストや微調整のたびに遅延が発生する。ローカル実行は、即座のフィードバックを意味する。この加速は、ラピッドプロトタイピングや、汎用的なクラウドモデルでは不十分な、特定のニッチなタスクにモデルをファインチューニングする上で極めて重要だ。君は、自社の社内ドキュメントや、個人の執筆スタイルに特化してモデルを学習させ、その結果をリアルタイムで見ることができる。

「先進的なAI能力の民主化は、もはや遠い未来ではない。それは、我々のパーソナルデバイス上で繰り広げられている、今日の現実なのだ。」この言葉は、一部のPR部門には高尚すぎると映るかもしれないが、まさに今起きていることの本質を捉えている。

もちろん、課題もある。君の個人のハードウェアがデータセンターと競合することはないだろう。パフォーマンスは、GPU、RAM、そして実行しようとしているモデルのサイズによって大きく変動する。大規模なモデルのローカルファインチューニングは、多くの人にとってまだ厳しいかもしれない。しかし、推論――学習済みモデルを使って出力を生成する行為――や、小さく高度に最適化されたモデルの実行においては、参入障壁は劇的に低下した。

ローカルAIのアーキテクチャ的基盤

このローカルAIブームを支える「どのように」は、実に興味深い。それは、コンシューマーハードウェアにおけるGPU効率とVRAM容量の継続的かつ執拗な向上、そしてモデルの量子化(quantization)やプルーニング(pruning)といった技術の著しい進歩が結実したものだ。例えば、量子化は、モデルのパラメータを表す数値の精度を低減させるプロセスであり、精度の大幅な低下なしにモデルをより小さく、より速くする。プルーニングは、ニューラルネットワーク内の冗長または重要度の低い接続を削除することだ。

さらに、llama.cppとその仲間のようなフレームワークが極めて重要だ。これらのプロジェクトは、大規模言語モデルを標準的なCPUやGPUで効率的に実行することに特化している。彼らは、オープンソースソフトウェア開発の黎明期を彷彿とさせるほどの激しさで、メモリ管理、計算最適化、そしてプラットフォーム互換性に取り組んでいる。

これは単にLLMを実行可能にするということではない。それを「実用的」にするということだ。理論的可能性から広範なデプロイメントへと移行する際に生じるエンジニアリングの課題にかかっている。これらのオープンソースプロジェクトに取り組むチームは、多くの意味で、このローカルAI革命の陰の立役者であり、学術的なブレークスルーを、具体的で実用的なソフトウェアへと翻訳しているのだ。

結局のところ、これはAIパワーの分散化を意味する。大手プレイヤーは、ますます巨大なモデルでフロンティアを押し広げ続けるだろうが、実験、応用、さらには特殊なトレーニングのためのツールは、今やはるかに広範なコミュニティが手の届くところにある。これは、我々がまだ想像し始めたばかりの方法で、イノベーションを加速させることを約束するパラダイムシフトだ。

これが最終的に、巨大なクラウドAIの必要性を完全に置き換えるだろうか? 完全にはないだろう。最先端の研究、真にエクサスケール級のコンピューティングを必要とするモデルにとって、クラウドは依然として王様だ。しかし、多岐にわたるアプリケーション、個人の生産性、ニッチなビジネスツール、そしてより分散化され、プライバシーを重視したAIエコシステムの育成にとっては、ローカル革命はここにあり、それは君のマシン上で実行されている。

🧬 関連インサイト

- さらに読む: 国防総省の2億ドルAI ultimatum、Anthropicにブーメランとなる可能性

- さらに読む: Reasoning From Scratch 第1章:巧妙な導入か、巧妙なマーケティングか?

よくある質問

AIをローカルで実行するとはどういう意味ですか?

AIをローカルで実行するとは、大規模言語モデルのようなAIモデルを、リモートサーバーやクラウドサービスに依存するのではなく、自身のコンピューターのハードウェア(CPUまたはGPU)で直接実行することを意味します。

Gemma 4やOpenclawを実行するためにスーパーコンピューターが必要ですか?

必ずしもそうではありません。強力なGPUはより優れたパフォーマンスを提供しますが、これらのモデルはより効率的に動作するように設計されています。多くの場合、コンシューマーグレードのハードウェアで実行できますが、パフォーマンスはシステム仕様とモデルサイズによって異なります。

ローカルAIは、クラウドAIよりもプライベートですか?

一般的に、はい。AIモデルをローカルで実行する場合、データは処理のために外部サーバーに送信される必要がないため、プライバシーが大幅に向上し、データ漏洩のリスクが低減します。