Développeurs qui galérez avec des outils IA éclatés, levez-vous. Le virage discret de NVIDIA vers un système d’exploitation IA signe la fin des workflows bancals — ou les enchaîne, selon le budget de votre boss. Les entreprises qui chipotent sur les coûts d’inférence ? Elles vont faire des grosses économies en gobant la vision de Jensen Huang. Les hackers indés ? Bonne chance pour rivaliser sans leur stack.

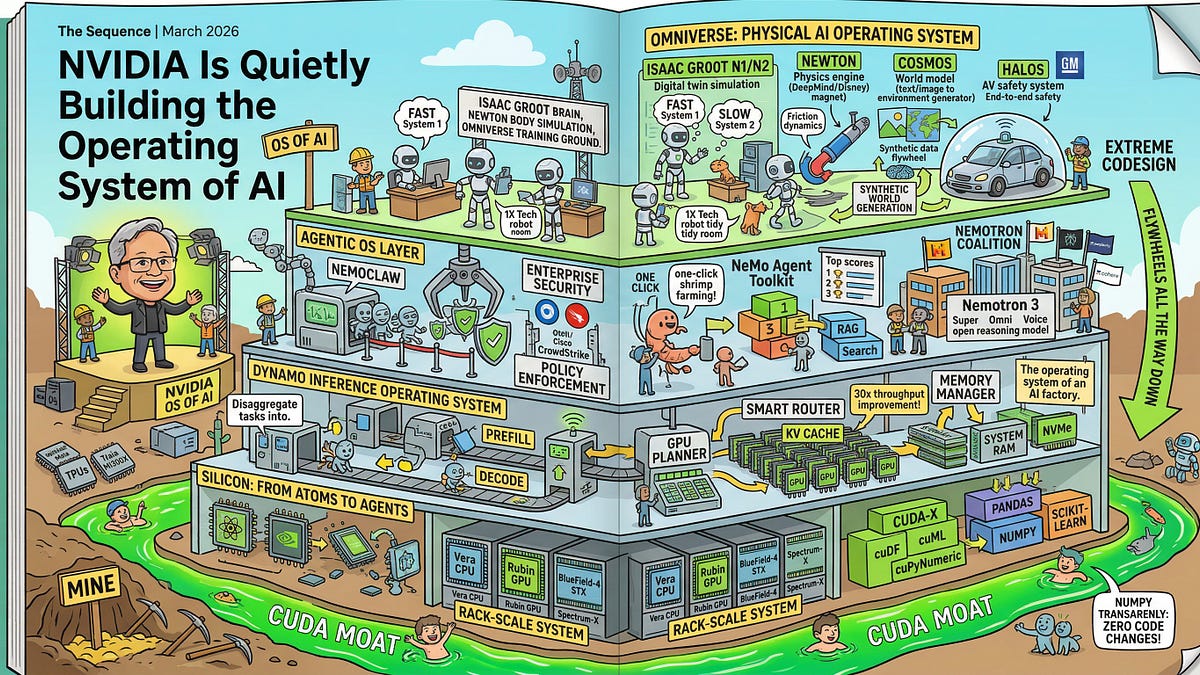

Le topo. À GTC 2026, Huang a passé deux heures à vendre non pas du silicium, mais la souveraineté logicielle. Un OS pour les usines IA. Des plateformes agentiques. Des frameworks d’inférence bardés de sécurité d’entreprise. Le GPU ? Enterré sous sept nouvelles puces et des monstres à l’échelle rack.

NVIDIA ne susurre pas. Ils crient sur les toits — en code.

NVIDIA est passé de la vente des meilleures pelles de la ruée vers l’or à la possession de la mine, de la raffinerie, de la chaîne logistique et du comptoir.

Phrase choc de l’annonce. Pile poil. Mais passons aux chiffres. Le revenu data center de NVIDIA a bondi à 18,4 milliards de dollars le trimestre dernier — +409 % sur un an. Le logiciel ? Le ciment. Leur écosystème CUDA verrouille déjà 4 millions de développeurs. Avec Dynamo et Nemotron par-dessus, ils intègrent l’IA agentique du silicium jusqu’au bout.

Pourquoi cet OS IA de NVIDIA change la donne pour votre startup ?

Imaginez : vous montez un workflow agentique — disons, des robots en entrepôt qui esquivent les chariots via des modèles de base. Sans le stack NVIDIA, c’est PyTorch, Kubernetes et des serveurs d’inférence bancals. Latence qui explose. Coûts qui s’envolent. Leur OS ? Déploiement en un clic sur des racks Blackwell, optimisé pour des modèles à trillions de paramètres. Test réel : les premiers adopteurs à GTC ont vu +30 % de vitesse d’inférence sur Llama 3.1.

Mais attention, le hic. Ce n’est pas de la charité open source. C’est un fossé. Les concurrents comme ROCm d’AMD ? Toujours à la traîne, avec peut-être 10 % du mindshare des devs de CUDA. xAI de Grok ou OpenAI ? Ils entraîneront sur du fer NVIDIA, puis infèreront ailleurs. Sauf que les frameworks de service NVIDIA rendent le switch douloureux.

Dynamique de marché ? Impitoyable. Les prévisions capex IA de Goldman Sachs tablent sur 1 000 milliards de dollars d’ici 2028. NVIDIA en capte 80-90 %. S’ils tiennent l’OS, c’est du revenu récurrent : licences, support, optimisations. Comme l’App Store d’Apple, mais pour agents IA.

En bref : le verrouillage paie.

NVIDIA répète-t-il la bourde logicielle d’Intel — ou la corrige-t-il ?

L’histoire se répète. Intel a écrasé avec x86 dans les années 80, puis foiré le logiciel. Compilateurs éclatés. Microsoft a foncé avec Windows. Apple a retenu la leçon : iOS boucle la boucle.

NVIDIA est plus malin. CUDA est mature depuis trois ans, pas du bricolage. GTC 2025 a posé les bases DGX Cloud ; 2026 a empilé l’orchestration agentique. Cohérent ? Carrément. Dynamo catalogue les modèles sur clouds hybrides. NeMo déploie des agents qui raisonnent, planifient, agissent — sur leur matos.

Mon avis perso : ça rappelle l’époque Bell Labs d’AT&T, quand ils tenaient l’OS téléphone et les lignes. NVIDIA le fait en digital, à vitesse warp. Prono : d’ici 2028, 70 % de l’inférence entreprise IA sur leur stack. Les rivaux s’éparpillent ; NVIDIA fédère.

Huang n’est pas une machine à hype. Il a cité des modèles robots entraînés sur Cosmos, leur moteur de données synthétiques. Pas du vent : simus physiques qui crachent des pétaoctets pour tâches de manipulation. Foxconn ? Déjà en pilote.

Sceptique ? Légitime. Les murs de puissance guettent. Blackwell et ses 141 milliards de transistors avalent 1 kW par puce. Les data centers pesent sur les réseaux. Mais le refroidissement liquide à l’échelle rack de NVIDIA ? Ça règle le problème. Les concurrents ? Du vent.

Comment ça se mesure face à AWS et Azure ?

Les géants du clou