Desenvolvedores se virando com ferramentas de IA fragmentadas, acordem. A virada discreta da NVIDIA para um SO de IA quer dizer que seus workflows vão ficar mais fluidos — ou acorrentados, dependendo do orçamento do seu chefe. Empresas apertando o cinto nos custos de inferência? Vão economizar uma grana preta se comprarem a visão do Jensen Huang. Mas hackers independentes? Boa sorte pra competir sem o stack deles.

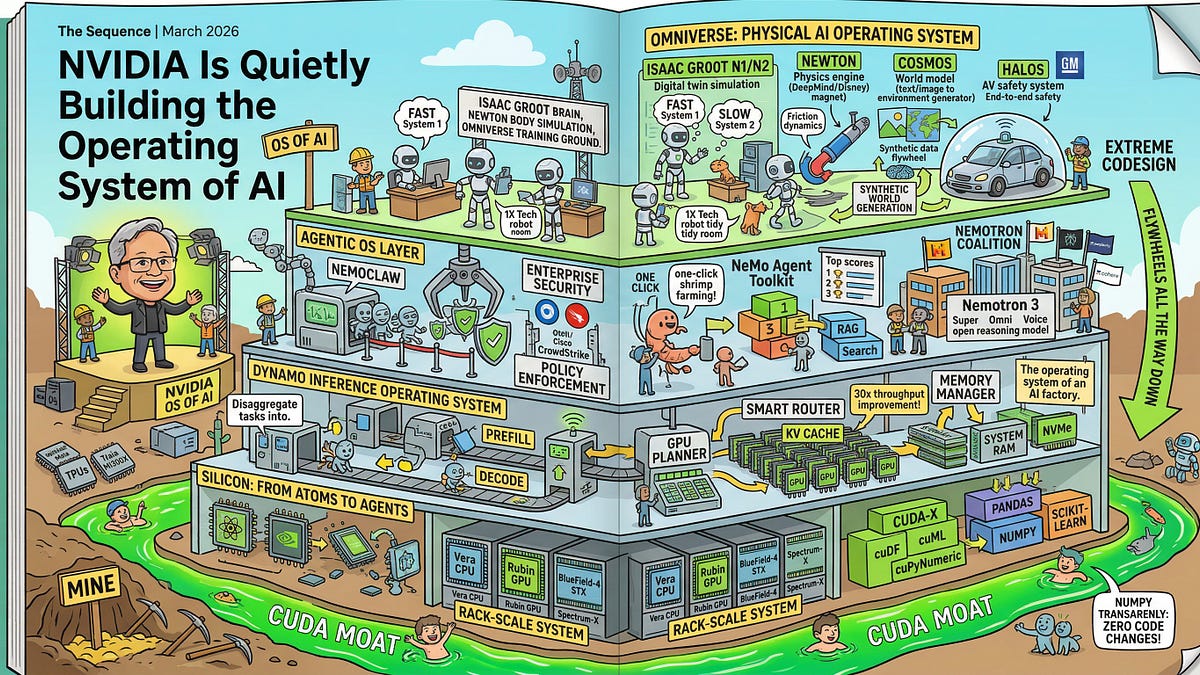

O lance é o seguinte. No GTC 2026, o Huang passou duas horas vendendo não silício, mas soberania em software. Um SO para fábricas de IA. Plataformas agentic. Frameworks de inferência recheados de segurança enterprise. A GPU? Enterrada como notícia velha sob sete chips novos e feras em escala de rack.

A NVIDIA não tá sussurrando bobagens. Tá gritando dos telhados — em código.

A NVIDIA passou de vender as melhores picaretas na corrida do ouro pra dominar a mina, a refinaria, a cadeia de suprimentos e a loja.

Essa é a frase matadora do anúncio. Certeira. Mas vamos aos números. A receita de data center da NVIDIA bateu US$ 18,4 bilhões no último trimestre — alta de 409% ano a ano. Software? É o cimento. O ecossistema CUDA já prende 4 milhões de devs. Agora, com Dynamo e Nemotron por cima, eles embutem IA agentic desde o silício.

Por Que o SO de IA da NVIDIA Importa pro Seu Startup?

Imagina: você bootstrapeando um workflow agentic — tipo, robôs em armazéns desviando de empilhadeiras com modelos foundation. Sem o stack da NVIDIA, é costurar PyTorch, Kubernetes e servidores de inferência meia-boca. Latência explode. Custos incham. O SO deles? Implantação com um clique em racks Blackwell, otimizado pra modelos de trilhão de parâmetros. Teste real: early adopters no GTC viram 30% de ganho em velocidade de inferência no Llama 3.1.

Mas tem pegadinha. Não é caridade open source. É um fosso. Concorrentes tipo ROCm da AMD? Ainda correndo atrás, com mindshare de devs em uns 10% do CUDA. xAI do Grok ou OpenAI? Treinam no ferro da NVIDIA, inferem em outro lugar. Só que agora os frameworks de serving deles tornam a troca uma dor de cabeça.

E a dinâmica de mercado? Brutal. Previsões de capex em IA do Goldman Sachs apontam US$ 1 trilhão até 2028. NVIDIA manda em 80-90%. Se dominarem o SO, é receita recorrente — licenças, suporte, otimizações. Pense na App Store da Apple, mas pra agentes de IA.

Resumindo: lock-in vence.

A NVIDIA Tá Repetindo o Erro de Software da Intel — ou Consertando?

A história rimou. Intel esmagou com chips x86 nos anos 80, depois vacilou no software. Compiladores fragmentados. Microsoft voou com Windows. Apple aprendeu: iOS controla o ciclo todo.

NVIDIA é mais esperta. Fazem três anos de maturidade no CUDA, não partem do zero. GTC 2025 trouxe basics do DGX Cloud; 2026 empilhou orquestração agentic. Coerente? Com certeza. Dynamo cataloga modelos em nuvens híbridas. NeMo implanta agentes que raciocinam, planejam, agem — no hardware deles.

Minha visão exclusiva: isso lembra a era Bell Labs da AT&T, quando controlavam o SO do telefone e as linhas. NVIDIA faz digital, na velocidade da luz. Previsão? Até 2028, 70% da inferência enterprise de IA roda no stack deles. Rivais se fragmentam; NVIDIA federariza.

Olha, Huang não é máquina de hype. Citou modelos de robô treinados no Cosmos, o motor de dados sintéticos deles. Não é enfeite — simulações físicas gerando petabytes pra tarefas de manipulação. Empresas tipo Foxconn? Já em piloto.

Cético? Justo. Paredes de energia à vista. Blackwell com 141 bilhões de transistores engole 1kW por chip. Data centers forçam as redes elétricas. Mas o resfriamento líquido em escala de rack da NVIDIA? Resolve. Concorrentes? Fumaça.

Como Isso se Compara com AWS e Azure?

Gigantes de nuvem oferecem IA gerenciada — Bedrock, SageMaker. Flexível? Claro. Mas a soberania on-prem da NVIDIA atrai as Fortune 500 paranoicas. Stacks de segurança com computing confidencial? Tem.