Sviluppatori che arrancano con tool AI frammentati, svegliatevi. La svolta silenziosa di NVIDIA verso un sistema operativo AI significa che i vostri workflow si sono appena semplificati — o incatenati, a seconda del budget del vostro capo. Aziende che stringono la cinghia sui costi di inferenza? Risparmieranno un sacco se comprano la visione di Jensen Huang. Ma hacker indie? Buona fortuna a competere senza il loro stack.

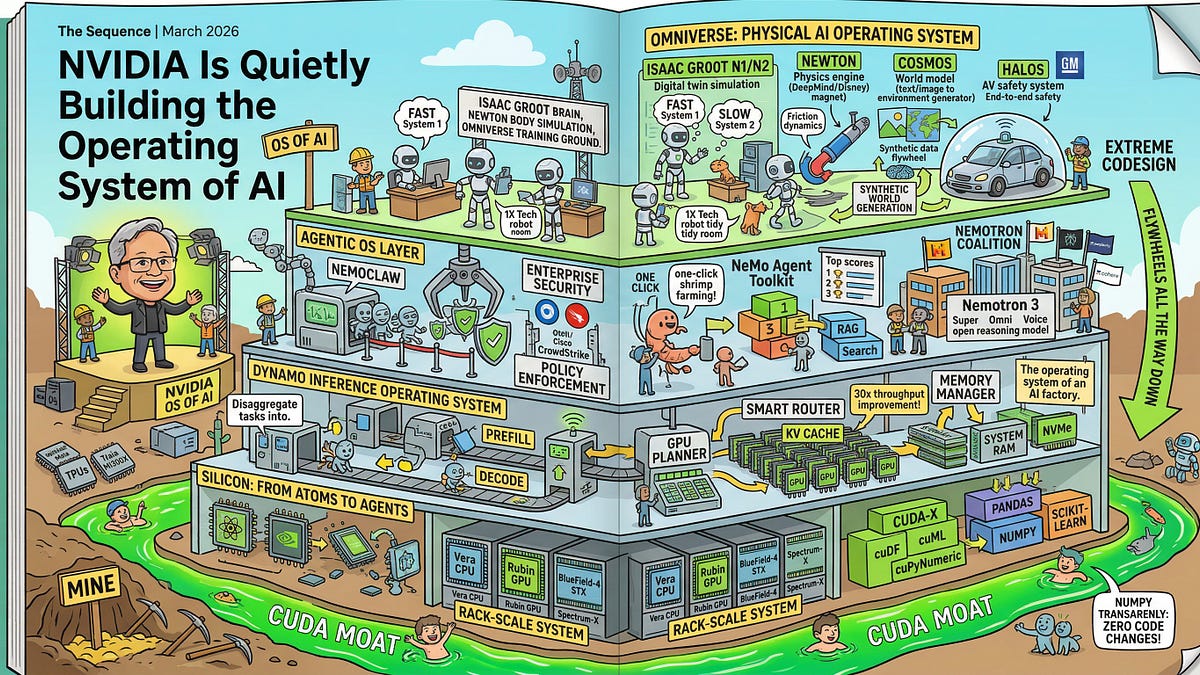

Il punto è questo. Al GTC 2026, Huang ha passato due ore a spingere non silicio, ma sovranità software. Un OS per le AI factories. Piattaforme agentiche. Framework di inferenza farciti di sicurezza enterprise. La GPU? Sepolta come una notizia di ieri sotto sette nuovi chip e bestie rack-scale.

NVIDIA non sussurra paroline dolci. Urlano dai tetti — in codice.

NVIDIA è passata dal vendere i migliori picconi durante la corsa all’oro a possedere la miniera, la raffineria, la catena di fornitura e il negozio.

Questa è la frase assassina dell’annuncio. Azzeccatissima. Ma crunchiamo i numeri. I ricavi data center di NVIDIA hanno toccato 18,4 miliardi di dollari l’ultimo trimestre — su del 409% anno su anno. Il software? È la colla. Il loro ecosistema CUDA già blocca 4 milioni di sviluppatori. Ora, con Dynamo e Nemotron sovrapposti, stanno cuocendo l’AI agentica dal silicio in su.

Perché l’OS AI di NVIDIA conta per la tua startup?

Immaginate: state bootstrappando un workflow agentico — tipo robot nei magazzini che schivano forklift tramite foundation model. Senza lo stack NVIDIA, cucite insieme PyTorch, Kubernetes e server di inferenza mezzi crudi. Latenza alle stelle. Costi che esplodono. Il loro OS? Distribuzione one-click su rack Blackwell, ottimizzata per modelli da trilioni di parametri. Test reali: i primi adottanti al GTC hanno riportato accelerazioni del 30% sull’inferenza di Llama 3.1.

Ma attenzione — c’è il trucco. Non è carità open source. È un fossato. Concorrenti come il ROCm di AMD? Ancora rincorrono, con mindshare degli sviluppatori al massimo del 10% di CUDA. Grok di xAI o OpenAI? Alleneranno su ferro NVIDIA, poi inferiranno altrove. Tranne che ora i framework di serving NVIDIA rendono il passaggio un incubo.

E le dinamiche di mercato? Spietate. Le stime capex AI di Goldman Sachs parlano di 1 trilione di dollari entro il 2028. NVIDIA ne comanda l‘80-90%. Se possiedono l’OS, è revenue ricorrente — licenze, supporto, ottimizzazioni. Pensate all’App Store di Apple, ma per agent AI.

Paragrafo breve: il lock-in vince.

NVIDIA sta ripetendo il flop software di Intel — o lo sta sistemando?

La storia si ripete. Intel ha dominato con chip x86 negli anni ‘80, poi ha toppato sul software. Compiler frammentati. Microsoft è piombata con Windows. Apple ha imparato: iOS controlla il loop.

NVIDIA è più furba. Con tre anni di maturità CUDA alle spalle, non partono da zero. Al GTC 2025 hanno sfornato le basi DGX Cloud; al GTC 2026 hanno aggiunto orchestrazione agentica. Coerente? Assolutamente. Dynamo cataloga modelli su cloud ibridi. NeMo distribuisce agent che ragionano, pianificano, agiscono — sul loro hardware.

La mia visione unica: ricorda l’era Bell Labs di AT&T, quando controllavano l’OS telefonico e le linee. NVIDIA lo fa in digitale, a velocità warp. Previsione? Entro il 2028, il 70% dell’inferenza AI enterprise gira sul loro stack. I rivali si frammentano; NVIDIA federerà.

Guardate, Huang non è una macchina del hype. Ha citato modelli robotici addestrati su Cosmos, il loro motore di dati sintetici. Non è aria fritta — sono sim fisiche che generano petabyte per task di manipolazione. Aziende come Foxconn? Già in pilota.

Scettici? Giusto. Muri energetici in arrivo. I 141 miliardi di transistor di Blackwell ingollano 1 kW per chip. I data center stressano le griglie. Ma il raffreddamento liquido rack-scale di NVIDIA? Lo risolve. Concorrenti? Vaporware.

Come si confronta con AWS e Azure?

I giganti cloud offrono AI ma