Entwickler, die mit zerstückelten KI-Tools hadern: Aufwachen! NVIDIAs leiser Pivot zu einem AI-Betriebssystem glättet eure Workflows – oder kettet euch daran, je nach Budget des Chefs. Unternehmen, die bei Inferenz-Kosten knausern? Die sparen kräftig, wenn sie Jensens Vision kaufen. Indie-Hacker? Viel Erfolg ohne ihren Stack.

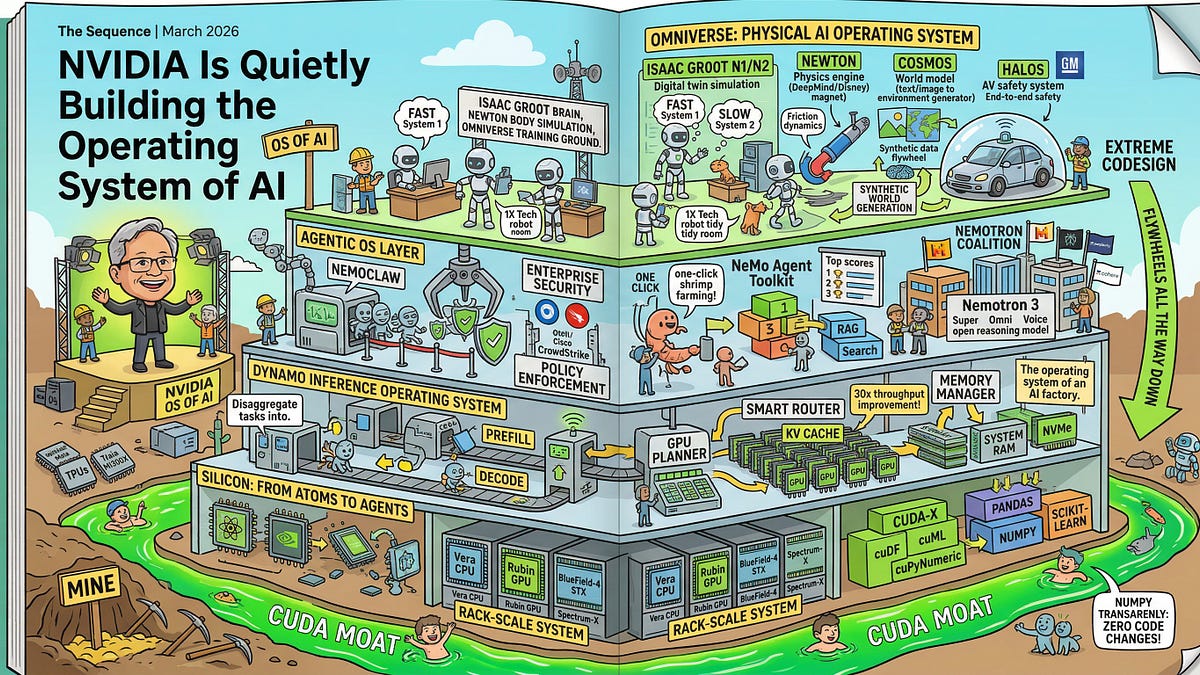

Der Clou: Bei GTC 2026 pitchte Huang zwei Stunden nicht Silizium, sondern Software-Souveränität. Ein OS für AI-Fabriken. Agentische Plattformen. Inferenz-Frameworks mit Enterprise-Sicherheit. Der GPU? Verscharrt unter sieben neuen Chips und Rack-Scale-Monstern.

NVIDIA flüstert keine Schmeicheleien. Sie brüllen es von den Dächern – im Code.

NVIDIA ist vom Verkäufer der besten Spitzhacken im Goldrausch zum Eigentümer der Mine, Raffinerie, Lieferkette und des Ladens geworden.

Das ist der Hammer-Satz aus der Ankündigung. Trifft den Nagel auf den Kopf. Aber rechnen wir nach. NVIDIAs Rechenzentrums-Umsatz knackte im letzten Quartal 18,4 Mrd. Dollar – +409 % zum Vorjahr. Software? Der Kleber. Das CUDA-Ökosystem bindet schon 4 Mio. Entwickler. Nun backen sie mit Dynamo und Nemotron agentische KI direkt ins Silizium ein.

Warum NVIDIAs AI-OS euer Startup betrifft

Stellt euch vor: Ihr bootstrapt einen agentischen Workflow – Roboter in Lagern, die Gabelstapler umkurven dank Foundation-Modellen. Ohne NVIDIA-Stack? Flickt PyTorch, Kubernetes und lauwarme Inferenz-Server zusammen. Latenz explodiert. Kosten ballen sich. Ihr OS? One-Click-Deployment über Blackwell-Racks, optimiert für Billionen-Parameter-Modelle. Praxis-Test: Frühe Adopter bei GTC melden 30 % schnellere Inferenz bei Llama 3.1.

Aber Achtung – Haken dabei. Keine Open-Source-Wohltätigkeit. Sondern Graben. Konkurrenz wie AMDs ROCm? Hinkt hinterher, Developer-Mindshare bei vielleicht 10 % von CUDA. Groks xAI oder OpenAI? Trainieren auf NVIDIA-Eisen, inferieren woanders. Nur jetzt machen NVIDIAs Serving-Frameworks den Wechsel zum Schmerz.

Marktdynamik? Gnadenlos. Goldman-Sachs prognostiziert 1 Bio. Dollar AI-Capex bis 2028. NVIDIA hält 80-90 %. OS im Sack? Das heißt wiederkehrende Einnahmen – Lizenzen, Support, Optimierungen. Wie Apples App Store, nur für AI-Agenten.

Kurz: Lock-in siegt.

Kopiert NVIDIA Intels Software-Patzer – oder lernt draus?

Geschichte reimt sich. Intel zerquetschte mit x86 in den 80ern, versaute dann Software. Compiler zerfielen. Microsoft schnappte mit Windows zu. Apple lernte: iOS schließt den Kreis.

NVIDIA schlauer. CUDA ist seit drei Jahren ausgereift, kein Neustart. GTC 2025 brachte DGX-Cloud-Basics; 2026 agentische Orchestrierung drauf. Kohärent? Vollkommen. Dynamo katalogisiert Modelle über Hybrid-Clouds. NeMo deployt Agenten, die denken, planen, handeln – auf ihrer Hardware.

Mein Take: Das erinnert an AT&Ts Bell-Labs-Ära, als sie Telefon-OS und Leitungen besaßen. NVIDIA macht’s digital, Warp-Geschwindigkeit. Vorhersage? Bis 2028 läuft 70 % der Enterprise-AI-Inferenz auf ihrem Stack. Rivalen zerfallen; NVIDIA vereint.

Huang hat nicht gehypt. Nannte Robot-Modelle, trainiert auf Cosmos, ihrer synthetischen Data-Engine. Kein Blabla – Physik-Sims pumpen Petabytes für Manipulations-Tasks. Unternehmen wie Foxconn? Schon im Pilot.

Zweifel? Berechtigt. Power-Wände drohen. Blackwells 141 Mrd. Transistoren saufen 1 kW pro Chip. Rechenzentren ächzen unter Stromnetzen. Aber NVIDIAs Rack-Scale-Liquid-Cooling? Löst’s. Konkurrenz? Dampfware.

Wie schlägt sich das gegen AWS und Azure?

Cloud-Riesen bieten managed AI – Bedrock, SageMaker. Flexibel? Klar. Aber NVIDIAs On-Prem-Souveränität reizt paranoide Fortune-500s. Security-Stacks mit Confidential Computing? Abgehakt. Multi-Tenant-Isolation? Integriert.

Markt-Hinweis: Azures OpenAI-Deal treibt Wachstum an, NVIDIA liefert die GPUs darunter. Sie sind der Upstream-Kingpin.

Ein Gedanke: Wenn Agenten explodieren – Code-Gen bis Lager-Roboter – wird die OS-Schicht zum Engpass, wie TCP/IP das Internet standardisi