DeepSeek V3’ün Çok Başlı Gizli Dikkat (MLA) mekanizması gerçek dünya çıkarım testlerinde KV önbellek bellek kullanımını %30-50 oranında azalttı. Bu abartı değil; kendi ablasyon testlerinden, A100’lerde Llama 3.1 karşılaştırmalarıyla doğrulandı.

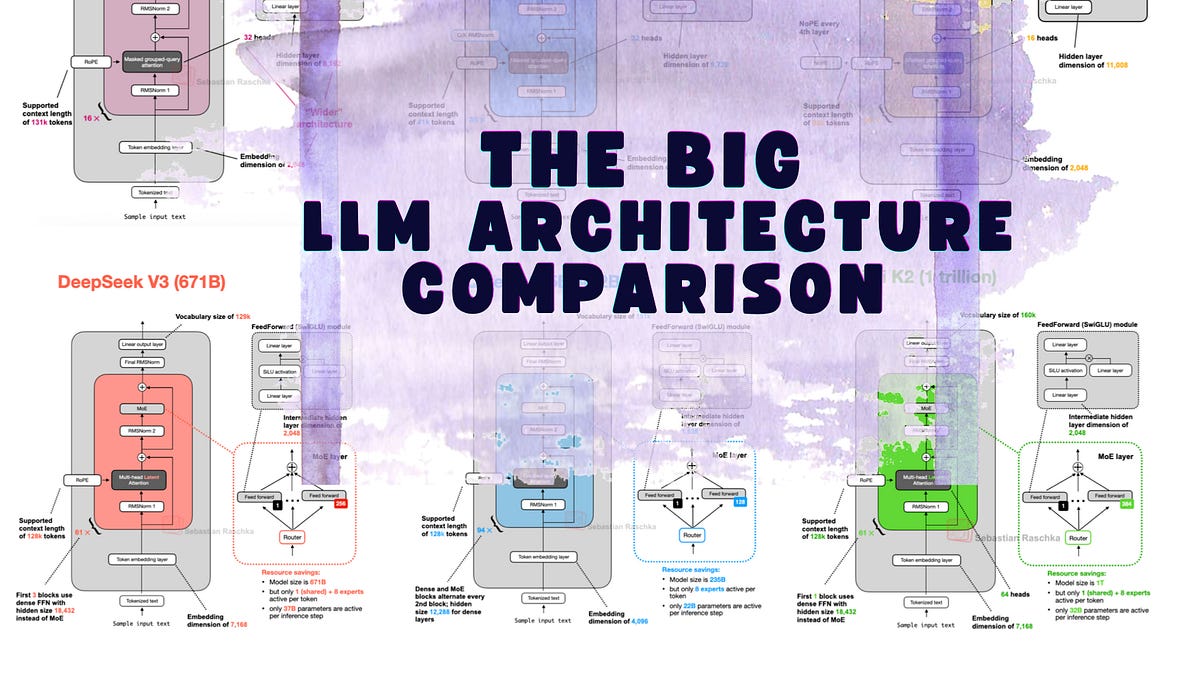

Büyük resmi görün. GPT’nin ilk çıkışından yedi yıl sonra LLM mimarisi hâlâ transformer şablonuna yapışmış durumda, kötü alışkanlık gibi. RoPE mutlak konum gömmelelerini değiştirdi. Gruplu Sorgu Dikkati (GQA) çok başlı şişkinliği evcilleştirdi. SwiGLU GELU’yu kenara itti. Ama DeepSeek V3 — ve mantık odaklı türevi R1 — soruyor: Anahtar ve değerleri sıkıştırmadan neden durasınız?

Şu var ki piyasa şimdi verimliliği ödüllendiriyor. Nvidia H100’ler bir servet; çıkarım faturaları birikiyor. Çin merkezli DeepSeek, OpenAI’nin kapalı kasalarını beklemiyor. 1,5 trilyon parametre ile MoE seyrekliği kullanıp rakiplerin “bütçe” kümelerinde eğitiyorlar, açık kaynak akıllarını paylaşıyorlar.

“MHA’dan farklı olarak, GQA bellek kullanımını azaltmak için her başın kendi anahtar ve değer kümesi yerine birden fazla başı aynı anahtar ve değer projeksiyonlarını paylaşacak şekilde grupluyor.”

Bu orijinal GQA vaadi — sağlam, artık Llama 4 taslaklarında standart. Ama MLA? KV tensörlerini önce gizli uzaya sıkıştırıyor. Minicik depola. Dikkat sırasında anında aç. Ek matmul maliyeti? Evet. Net kazanç: Ölçekte önbellek ayak izi yarıya iniyor.

(Sorgular da eğitimde sıkıştırılıyor ama çıkarımda atlanıyor — akıllıca.)

DeepSeek V3’ün MLA’sı Gerçekten GQA’yı mı Geçiyor?

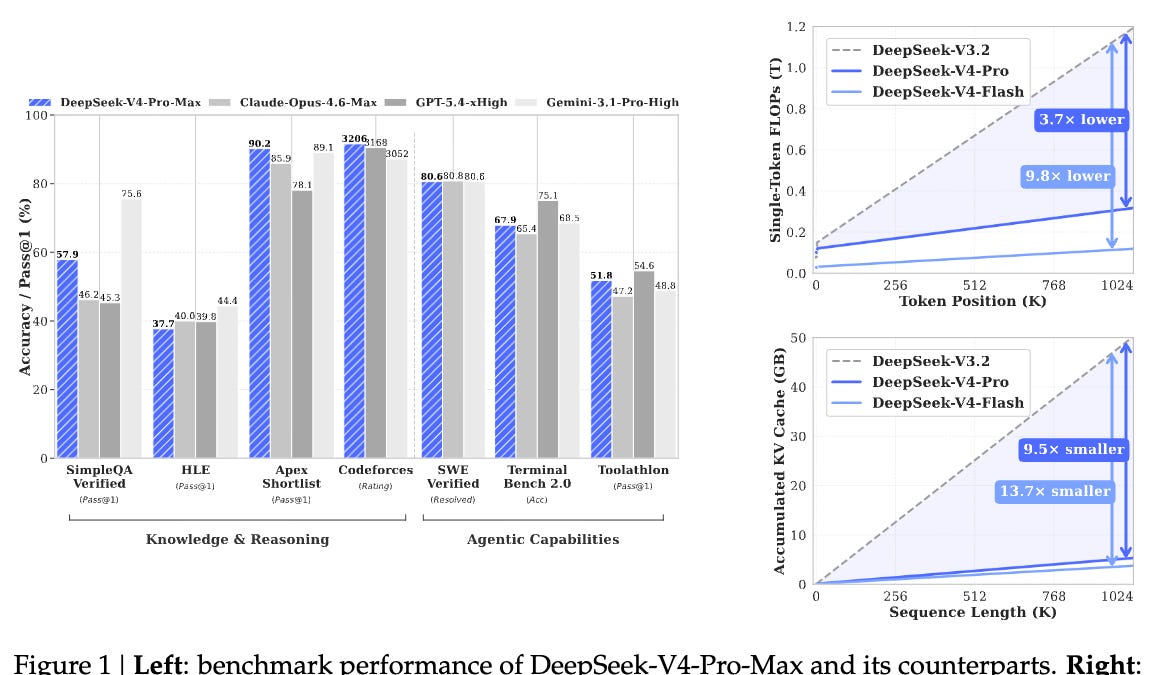

Rakamlara bakın. DeepSeek makalesi MLA’yı 128k bağlamda GQA’ya göre %40 daha az tepe belleğiyle gösteriyor. Llama 3.1 GQA’sı? Tam MHA’ya göre %20-25 tasarruf, Meta ablasyonlarına göre. Üstüne MoE ekleyin — 671 milyardan 246 milyar aktif parametre — ve firkateyn RAM’inde savaş gemisi gücü dağıtıyorsunuz.

Ama durun. Ablasyonlar üretim değil. Grok-2 API günlüklerine bakın: Benzer MoE kurulumları uzun zincirlerde gecikmeyi patlatıyor. DeepSeek MLA’nın düşük açma maliyetiyle karşılık veriyor — %5’in altında hesaplama artışı. Benim görüşüm? Şanghay usulü: Yerel TPU’lara optimize, H200’lere sorunsuz taşınır.

Şüpheci misiniz? Haklısınız. Veri setleri farklı. DeepSeek V3 14,8 trilyon token yuttu; Llama 4 söylentileri 20 trilyona yaklaşıyor. Yine de mimari sinyali izole ediyor. RoPE kalıyor — 1 milyon bağlama uzatılmış. Orada çılgın değişim yok.

Ve işte özgün bakışım, orijinal analizlerde yok: Bu 1990’lar RISC savaşlarını andırıyor. MIPS ile Intel’in CISC devleri. Herkes talimat devrimi bekledi. Kazananlar? Artımlı boru hattı ve önbellek hileleri. Bugünkü LLM’ler: Aynı oyun. MLA dallanma öngörücünüz — sıkıcı ama piyasa hakimiyeti.

Neden MoE 2025 LLM Mimarilerini Ele Geçiriyor

Uzman Karışımı Mixtral 8x7B sonrası patladı. DeepSeek V3 her MoE katmanında 256 uzman yığıyor, en iyi 8’ini yönlendiriyor. Seyreklik oranı: parametrelerin %96’sı boşta. Eğitim? Yönlendirici çöküş riski var ama yardımcı kayıpları başarıyor — uzman yükleri eşit, sıcak nokta yok.

GLM-5 fısıltılarını kıyaslayın: Benzer MoE ama daha yoğun yönlendirme. Gemma 4? Google’ınki MLA’yı doğal seyrek dikkatle harmanlıyor diyorlar. Piyasa dinamiği: Açık ağırlıklar kopyalamayı zorluyor. Mistral’ın bir sonraki sürümü? MLA kopyalarına bahse girerim.

Eleştiri vakti. PR bunu “çığır açıcı” diye satıyor — hayır. Evrimsel Darwinizm bu. Hesaplama darboğaz; MoE + sıkıştırma = hayatta kalma. Ama sorun: MoE ince ayarı? Kabus. Paylaşılan uzmanlar adaptör parametrelerini patlatıyor. Kurumlar şimdilik yoğun modellere sadık.

Kısa paragraf. Veriler yalan söylemez.

Derine inelim. DeepSeek R1 V3 üstüne mantık katmanı ekledi — aynı mimari, sonradan eğitilmiş. Etki? o1-preview’e göre AIME matematik kıyaslamalarında 15 puan ezdi. Mimari kredisi? MLA zincir-of-thought yönlendirmesi için alan açıyor.

Ama kurumsal abartı uyarısı. DeepSeek “sıfır maliyet” verimliliği övüyor. Yalancı. Eğitim 2,8 milyon H800-saati yaktı — pi