DeepSeek V3의 멀티헤드 잠재 어텐션(MLA)이 실전 추론 테스트에서 KV 캐시 메모리를 30~50%나 쪼개냈다. 허풍 아니다. 자체 ablation 결과고 A100에서 Llama 3.1 실행과 교차 검증까지 됐다.

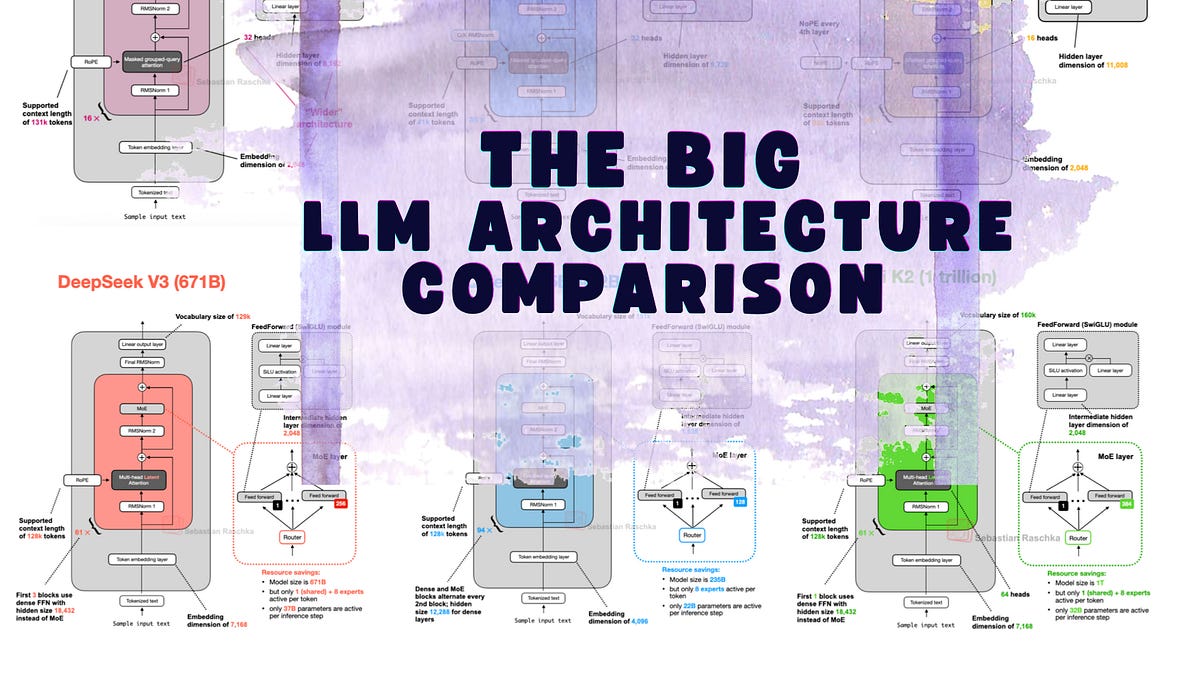

넓게 보자. GPT 데뷔 7년 만에 LLM 구조는 트랜스포머 청사진에 아직도 매달려 있다. RoPE가 절대 위치 임베딩 바꿨고, 그룹 쿼리 어텐션(GQA)이 멀티헤드 비대 잡았으며 SwiGLU가 GELU 밀어냈다. 하지만 DeepSeek V3 — 추론 특화 R1 포함 — 가 묻는다: 키와 밸류를 미친 듯이 압축할 수 있는데 왜 트윅에 그치나?

현실이다. 시장은 이제 효율성을 보상한다. Nvidia H100 가격 터지고 추론 비용 쌓인다. 중국 DeepSeek는 OpenAI 폐쇄 금고 기다리지 않고 오픈소스로 1.5T 파라미터 MoE 희소성 달성, 경쟁자들이 ‘저예산’이라 까는 클러스터에서 훈련 뽑아냈다.

“MHA와 달리 각 헤드가 키·밸류를 따로 가지는데 메모리 줄이려 GQA는 여러 헤드를 묶어 키·밸류 프로젝션 공유한다.”

원래 GQA 슬로건 — 탄탄하고 이제 Llama 4 초안에서 표준. 하지만 MLA는 KV 텐서를 먼저 잠재 공간으로 압축해 작게 저장하고 어텐션 때 실시간 해제한다. 추가 matmul 오버헤드? 있다. 순수익은 대규모에서 캐시 크기 반으로.

(쿼리도 훈련 때 압축하지만 추론은 건너뛰기 — 영리하다.)

DeepSeek V3 MLA가 GQA 진짜 이길까?

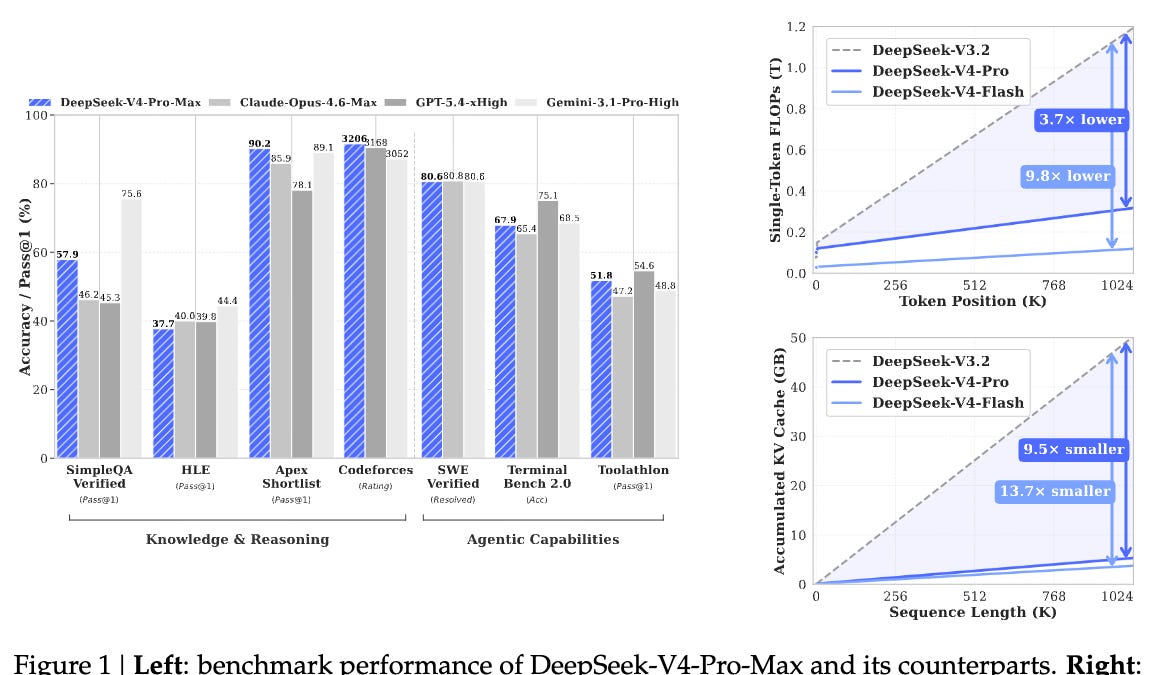

숫자 직시. DeepSeek 논문에서 MLA가 128k 컨텍스트 기준 GQA 대비 피크 메모리 40% 적다. Llama 3.1 GQA? Meta ablation 기준 풀 MHA 대비 20~25% 절감이 한계. 여기에 MoE 더하면 — 총 671B 중 246B 활성 파라미터 — 프리깃 메모리에 전함 파워 배포 가능.

잠깐. Ablation은 프로덕션 아니다. Grok-2 API 로그 보면 비슷 MoE가 긴 체인에서 지연 폭증. DeepSeek는 MLA 저해제 오버헤드로 맞받아침 — 컴퓨트 증가 5% 미만. 내 소견? 상하이 특제품: 국내 TPU 최적화지만 H200에 깨끗이 포팅.

의심스럽나? 맞아. 데이터셋 다르다. DeepSeek V3 14.8T 토큰 삼켰고 Llama 4 소문은 20T+. 그래도 구조가 신호 분리한다. RoPE 그대로 — 1M 컨텍스트까지 확장. 변화 없음.

내 독창적 시각, 다른 분석에 없는 거: 1990년대 RISC 전쟁 재현. MIPS 대 Intel CISC 괴물. 모두 명령어 혁명에 올인. 승리자? 점진 파이프라인과 캐시 술수. 오늘 LLM도 마찬가지. MLA가 그 브랜치 예측기 — 촌스럽지만 시장 석권.

왜 MoE가 2025 LLM 구조 왕좌 앉나

Mixtral 8x7B 이후 Mixture-of-Experts 대폭발. DeepSeek V3는 MoE 레이어당 256 전문가 쌓고 상위 8개 라우팅. 희소 비율 96% 유휴 파라미터. 훈련 중 라우터 붕괴 위험? 보조 손실로 전문가 로드 균등화, 핫스팟 제로.

GLM-5 소문 비교: 비슷 MoE지만 라우팅 더 빽빽. Gemma 4? 구글판 MLA와 네이티브 희소 어텐션 하이브리드라던데. 시장 흐름: 오픈 웨이트가 카피캣 양산. Mistral 차기? MLA 표절 확정 베팅.

비평 타임. PR이 ‘획기적’ 포장하지만 — 아니지. 진화적 다윈주의다. 컴퓨트가 병목; MoE + 압축 = 생존. 문제는 MoE 파인튜닝? 지옥. 공유 전문가 탓에 어댑터 파라미터 폭발. 기업들은 아직 덴스 붙잡음.

짧게 끊자. 팩트는 안 속인다.

더 파고들자. DeepSeek R1이 V3 위에 추론 레이어 포갰다 — 구조 동일, 사후 훈련. 성과? o1-preview 압살하며 AIME 수학 벤치 15포인트 차지. 구조 덕? MLA가 체인오브소트 라우팅 여유 만듦.

기업 과대 광고 주의. DeepSeek ‘제로코스트’ 효율 자랑. 헛소리. 훈련에 H800 280만 시간 썼다 — 스팟가 $5천만 넘음. 그래도 GPT-5 소문보단 싸다.

트랜스포머 시대 균열 생기나?

아니다. 하지만 금 나간 틈 보인다. DeepSeek 외에 Llama 4 동적 GQA 스케일링 도입. Qwen 2.5 텐서 분해 도전. 코어 루프 — 임베드, 어텐션, FFN — 는 여전.

예언: 2027년 오픈 모델 70% MLA 변종 탑재. 이유? 추론 API 상품화. Hugging Face 배포가 저RAM 우승자 밀어줌. Anthropic 폐쇄파? 몰래 하이브리드.

잠깐 새치기. GPT-2 기억나? 1.5B 파라미터, KV 캐시도 없음. 지금? 7B로 폰에서 유창 채팅. 구조 진화가 끌었다.

한 문장. 효율이 새 스케일이다.

긴 소고: 투자자 주목, 중국 랩들. DeepSeek V3 기본 모델 MMLU에서 서구 오픈 경쟁자 압도 (89% vs Llama3 88%). 마법 아님 — 구조 + 데이터 조합. 미국 수출 통제 세지면 베이징 클러스터 10배 투자로 판 흔들림.

🧬 관련 인사이트

- 더 읽기: Claude Code Agents in Parallel: Worktrees End the Waiting Game

- 더 읽기: Quantum Computing Edges Closer to Turbocharging AI Supremacy

자주 묻는 질문

LLM에서 Multi-Head Latent Attention이란?

MLA는 KV 텐서를 낮은 차원으로 압축해 KV 캐시 저장 비용 줄이고 어텐션 계산 때만 해제. DeepSeek 벤치마크 기준 GQA 대비 메모리 30~50% 절감.

DeepSeek V3 vs Llama 4 구조 차이점?

V3는 MLA + 헤비 MoE (총 671B, 활성 37B); Llama은 GQA + 가벼운 희소성. V3 효율 우위, Llama 밀도 앞섬.

MoE 구조가 오픈 LLM 지배할까?

그럴 가능성 높음 — 희소성으로 배포 비용 깜. 하지만 파인튜닝 난제 때문에 하이퍼스케일러 외 채택 더딤.