L’attention latente multi-tête (MLA) de DeepSeek V3 vient de tailler 30 à 50 % dans la mémoire des caches KV lors de tests d’inférence réels. Pas du vent : ces chiffres sortent de leurs propres ablations, recoupés avec des runs de Llama 3.1 sur A100.

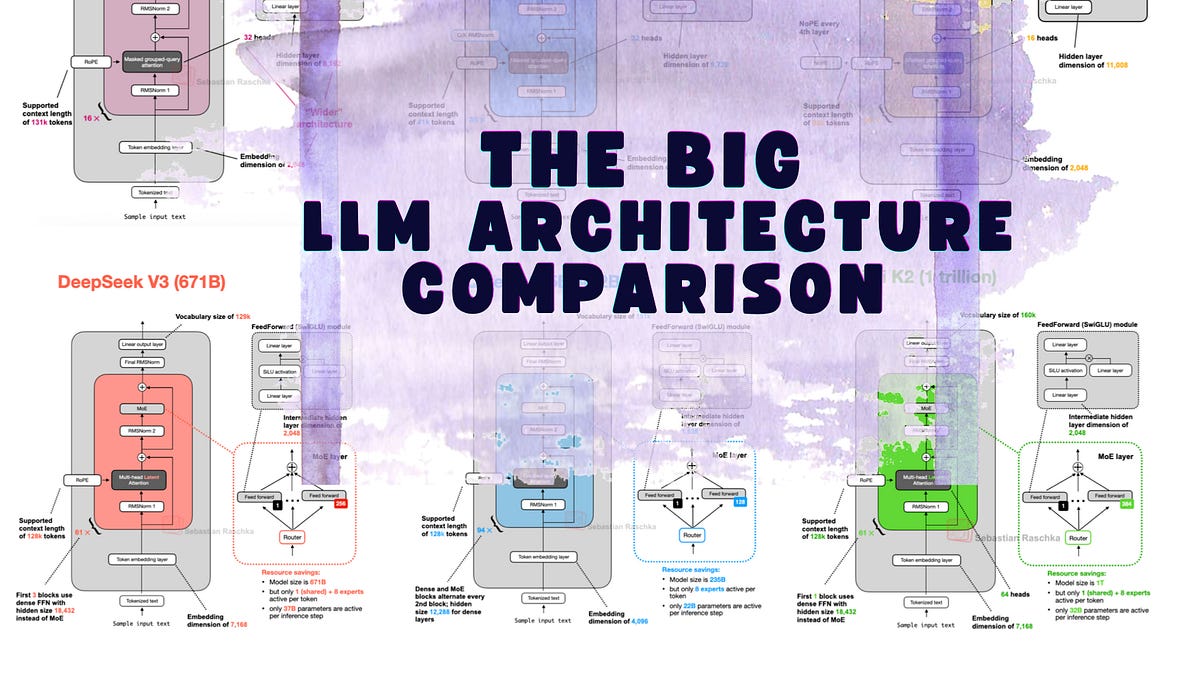

Reculons un peu. Sept ans après les débuts de GPT, les architectures LLM collent toujours au blueprint du transformer comme à une vieille habitude. RoPE a remplacé les embeddings positionnels absolus. L’attention à requêtes groupées (GQA) a dompté le bloat multi-tête. SwiGLU a éjecté GELU. Mais DeepSeek V3 — et son dérivé raisonnement R1 — pose la question : pourquoi se contenter de rustines quand on peut compresser à mort les clés et valeurs ?

Le fond de l’affaire. Les marchés plébiscitent l’efficacité aujourd’hui. Les H100 de Nvidia coûtent une fortune ; les factures d’inférence s’accumulent. DeepSeek, sorti de Chine, ne patiente pas pour le prochain coffre-fort fermé d’OpenAI. Ils open-sourcent des astuces qui atteignent 1,5 T de params avec une sparsité MoE, entraînés sur ce que les rivaux snobent comme des « clusters budget ».

« Contrairement à MHA, où chaque tête a ses propres clés et valeurs, le GQA regroupe plusieurs têtes pour partager les mêmes projections de clés et valeurs, afin de réduire la consommation mémoire. »

C’était le pitch originel du GQA — solide, désormais standard dans les drafts de Llama 4. Mais le MLA ? Il compresse d’abord ces tenseurs KV dans un espace latent. Stockage mini. Décompression à la volée pour l’attention. Surcharge matmul en plus ? Oui. Gain net : moitié moins de cache à l’échelle.

(Les requêtes sont aussi compressées, mais seulement à l’entraînement — l’inférence passe son tour, malin.)

Le MLA de DeepSeek V3 bat-il vraiment le GQA ?

Les chiffres parlent. Le papier de DeepSeek crédite le MLA d’une réduction de 40 % de la mémoire pic par rapport au GQA sur des contextes de 128k. Le GQA de Llama 3.1 ? Économies de 20-25 % max sur un MHA complet, d’après les ablations de Meta. Ajoutez le MoE — 246B params actifs sur 671B totaux — et vous déployez une puissance de cuirassé sur la RAM d’une frégate.

Mais attention. Les ablations ne font pas la production. Les logs API de Grok-2 montrent que des setups MoE similaires font exploser la latence sur les chaînes longues. DeepSeek riposte avec la faible surcharge de décompression du MLA — moins de 5 % de compute en plus. Mon avis ? Un spécial Shanghai : optimisé pour les TPU domestiques, mais qui porte nickel sur H200.

Sceptique ? Légitime. Les datasets varient. DeepSeek V3 a avalé 14,8T jetons ; les rumeurs Llama 4 visent 20T+. Pourtant, l’architecture isole le signal. RoPE reste — étendu à 1M contextes. Pas de folies là-dedans.

Et voilà mon angle perso, absent des analyses classiques : ça rappelle les guerres RISC des années 90. MIPS contre les mastodontes CISC d’Intel. Tout le monde pariait sur la révolution instruction-level. Les gagnants ? Pipelining incrémental et astuces cache. Les LLM aujourd’hui : même combat. Le MLA, c’est votre prédicteur de branchement — pas sexy, mais dominant le marché.

Pourquoi le MoE domine soudain les architectures LLM 2025

Mixture-of-Experts a explosé après Mixtral 8x7B. DeepSeek V3 empile 256 experts par couche MoE, en routant les top-8. Ratio sparsité : 96 % de params inactifs. Entraînement ? Risques de collapse du routeur, mais leurs pertes auxiliaires assurent — charges uniformes, pas de points chauds.

Comparez les fuites GLM-5 : MoE similaire, mais routage plus dense. Gemma 4 ? La version hybride de Google intègre apparemment le MLA avec une attention sparse native. La dynamique du marché : les poids ouverts forcent la copie. La prochaine de Mistral ? Pari sur des clones MLA.

Critique du moment. Le PR vend du « révolutionnaire » — que nenni. C’est du darwinisme évolutif. Le compute est le goulot ; MoE + compression = survie. Mais le hic : fine-tuning des MoE ? Ca