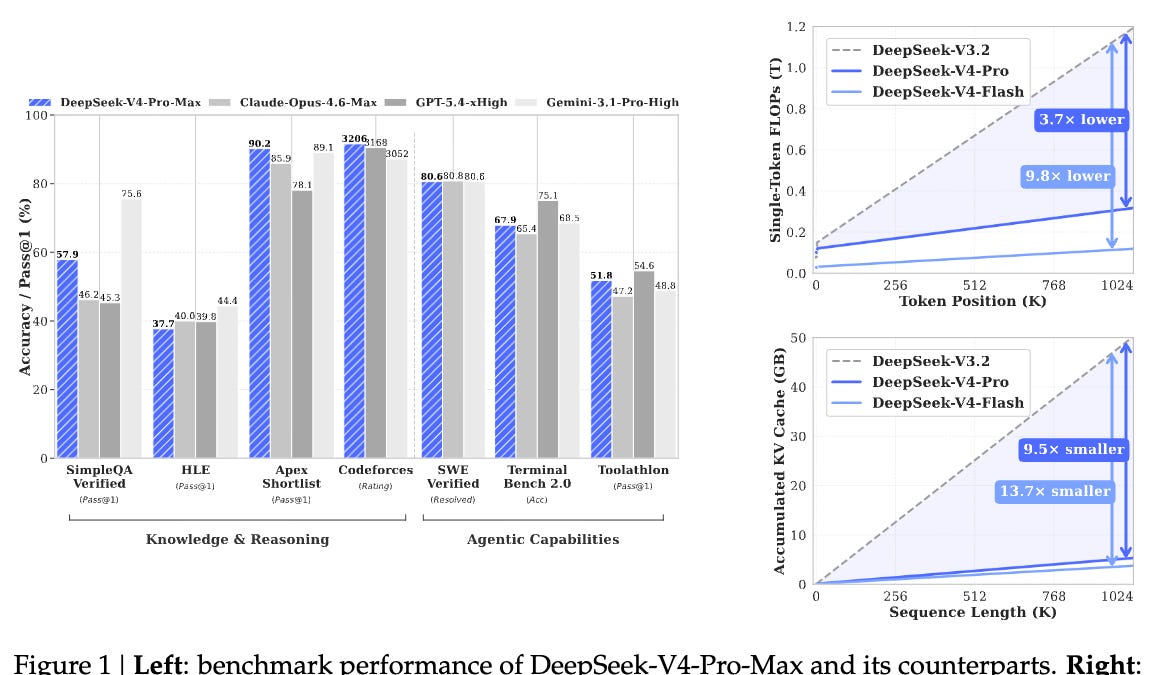

DeepSeek V3のMulti-Head Latent Attention(MLA)は、実世界の推論テストでKVキャッシュメモリを30-50%削ぎ落とした。これはハッタリじゃない。自社のアブレーション結果で、A100上でのLlama 3.1実行とクロスチェック済みだ。

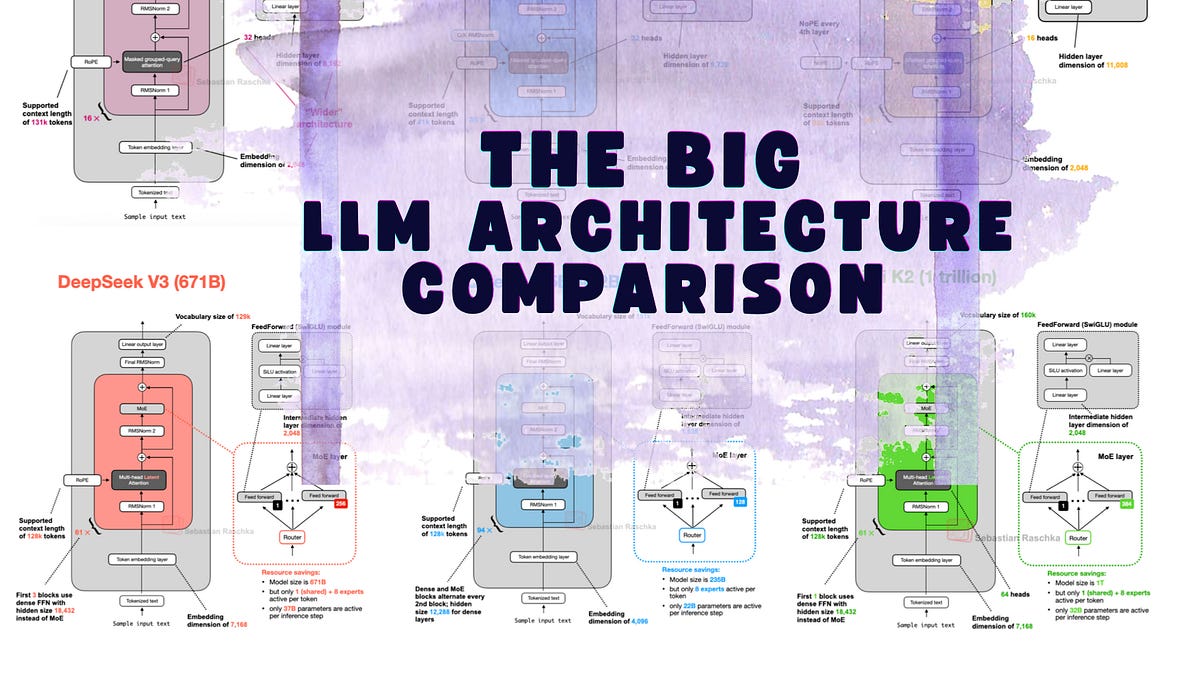

視野を広げよう。GPT登場から7年経つ今も、LLMアーキテクチャはトランスフォーマーの設計図にしがみついている。RoPEが絶対位置埋め込みを置き換え、Grouped-Query Attention(GQA)が多頭の無駄を抑え、SwiGLUがGELUを押し出した。だがDeepSeek V3——そして推論特化の派生R1——は問う:キー&バリューの圧縮で中途半端なチューンを超えろよ、と。

本質はここだ。市場は今、効率を金で買う。NvidiaのH100はバカ高で、推論コストが積み上がる。中国発のDeepSeekはOpenAIの次なるクローズドボックスを待たず、オープンソースで1.5兆パラメータ級のMoEスパースを「予算クラスター」で叩き出した。

“Unlike MHA, where each head also has its own set of keys and values, to reduce memory usage, GQA groups multiple heads to share the same key and value projections.”

これがGQAのオリジナルピッチ——今やLlama 4のドラフトで標準だ。だがMLAはKVテンソルをまず潜在空間に圧縮。格納は超コンパクトで、注意計算時にオンザフライで展開。追加の行列積オーバーヘッド? 確かにある。だがスケールでネット勝ち:キャッシュフットプリントが半分だ。

(クエリも訓練時のみ圧縮——推論ではスキップ、賢い)。

DeepSeek V3のMLA、本当にGQAを上回るか?

数字を見ろ。DeepSeekの論文では、128kコンテキストでMLAがGQA比40%のピークメモリ削減。Llama 3.1のGQA? MetaのアブレーションでフルMHA比20-25%止まりだ。MoEを加え——総671B中246Bがアクティブ——戦艦パワーをフリゲートRAMでデプロイ可能になる。

だが待て、アブレーションは本番じゃない。Grok-2のAPIログを見れば、同種MoEで長チェーン遅延スパイクだ。DeepSeekはMLAの低展開オーバーヘッドで対抗——計算増は5%未満。筆者の見立て? 上海特化の最適化だが、H200に綺麗にポートできる。

懐疑的か? 当然だ。データセットが違う。DeepSeek V3は14.8Tトークンを貪り、Llama 4の噂は20T超え。だがアーキテクチャがシグナルを分離。RoPEは残り、100万コンテキストまで拡張。乱れなし。

ここで独自視点、オリジナル解説にないもの:1990年代RISC戦争の再来だ。MIPS対IntelのCISC巨獣。皆が命令レベルの革命を賭けた。勝者? 漸進パイプラインとキャッシュトリック。今日のLLMも同じ。MLAはブランチプリディクタ——地味だが市場制覇。

なぜMoEが2025年LLMアーキテクチャを支配するのか

Mixture-of-ExpertsはMixtral 8x7B以降爆発。DeepSeek V3はMoE層あたり256エキスパートを積み、トップ8ルーティング。スパース比96%アイドル。訓練? ルータ崩壊リスクを補助損失で封じ——エキスパート負荷均一、ホットスポットなし。

GLM-5の噂と比較:似たMoEだがルーティング密。Gemma 4? Google版はMLAとネイティブスパース注意のハイブリッドらしい。市場ダイナミクス:オープンウェイトがコピーキャットを強いる。Mistralの次? MLAのパクリに賭けろ。

批判の時間だ。PRは「画期的」と煽る——違う。進化ダーウィニズムだ。計算がボトルネック、MoE+圧縮=生存。問題はファインチューニング:共有エキスパートでアダプタパラ爆増。企業は当分密モデルに固執。

短く。事実が語る。

深掘り。DeepSeek R1はV3上に推論をレイヤリング——同アーキテクチャ、後訓練。インパクト? AIME数学ベンチでo1-preview比15ポイント圧勝。アーキテクチャの功績? MLAがチェーン・オブ・ソート・ルーティングに頭室を空ける。

企業ハイプ警報。DeepSeekは「ゼロコスト」効率と豪語——嘘だ。訓練にH800時間2.8M——スポット価格で5000万ドル超。GPT-5噂より安いが。

トランスフォーマー時代、ついに綻びるか?

いや。だが綻びが見える。DeepSeek以外:Llama 4は動的GQAスケーリング統合。Qwen 2.5はテンソル分解に手を出そうとする。だがコアループ——埋め込み、注意、FFN——は耐える。

予測:2027年までにMLAバリアントがオープン70%。理由? 推論APIがコモディティ化。Hugging Faceデプロイは低RAM勝者優位。Anthropicのようなクローズドは静かにハイブリッド化。

少し脱線。GPT-2を思い出せ? 15Bパラ、無KVキャッシュ。今? 7Bがスマホで流暢チャット。アーキテクチャ進化が駆動。

一文。効率が新スケールだ。

長考:投資家よ、中国ラボを注視せよ。DeepSeek V3ベースはMMLUで西方オープン(Llama3 88%)を抜き89%。魔法じゃない——アーキ+データミックス。米輸出規制が食いしばる中、北京のインフラ投資(10倍クラスター)がフィールドを傾ける。

🧬 関連インサイト

- 詳細: Claude Code Agents in Parallel: Worktrees End the Waiting Game

- 詳細: Quantum Computing Edges Closer to Turbocharging AI Supremacy

よくある質問

LLMにおけるMulti-Head Latent Attentionとは?

MLAはKVテンソルを低次元に圧縮し、KVキャッシュを安く格納。注意計算時のみ展開。DeepSeekベンチでGQA比30-50%メモリカット。

DeepSeek V3とLlama 4のアーキテクチャ差は?

V3はMLA+ヘビーMoE(総671B、アク37B);LlamaはGQA+ライトスパース。V3が効率勝ち、Llamaが密度優位。

MoEアーキテクチャがオープンLLMを支配するか?

ほぼ確実——スパースがデプロイコストを斬る。だがファインチューニングの壁でハイパースケーラー外の採用は遅れ。