NotebookLM com Google AI Ultra agora permite gerar 20 resumos em vídeo cinematográfico por dia — isso dá uns 10 horas de visuais feitos por IA se cada um rodar 3 minutos.

E o pulo do gato: não é só clipe bonitinho. O Google misturou Gemini 1.5 Pro, Imagen (que eles chamam de Nano Banana Pro?) e Veo 2 num pipeline que transforma suas anotações enviadas — PDFs, docs, o que for — em animações fluidas com visuais caprichados. Imagina vídeos explicativos personalizados sobre física quântica ou sua última proposta de vendas, tudo sem sair do notebook.

“animações fluidas e visuais ricos e detalhados pra te ajudar a aprender e se engajar com os temas que você curte.”

Trecho direto do anúncio do Google. Parece irado. Mas vamos cortar o blá-blá-blá: o limite de 20/dia é pra controlar os custos de computação, jogada clássica das big techs quando escalam IA generativa multimodal.

NotebookLM com Gemini: De Anotações a Clipes no Estilo Netflix?

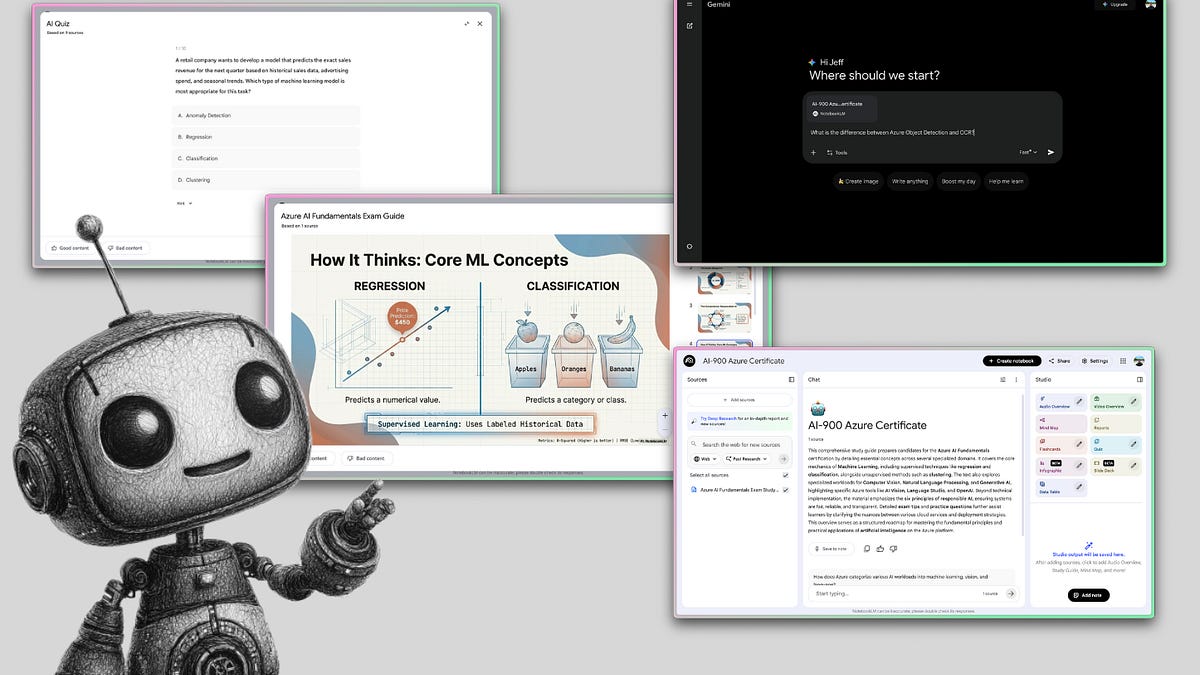

Olha, eu testei as versões iniciais do NotebookLM. Joga um doc de pesquisa sobre baterias de EV, clica em gerar e pá — vídeo narrado com gráficos que dão zoom, imagens de estoque que se transformam, até B-roll sutil. As habilidades multimodais do Gemini brilham aqui; ele entende o texto, busca visuais, roteiriza a narração.

Usuários estão pirando nos fóruns — o feed do NotebookLM no Twitter (ou X) tá lotado de threads “mente explodida”. Mas o limite de 20 vídeos? É uma barreira. Plano grátis leva zero; te empurra pro Ultra a US$ 20/mês (ou o que for em 2026). Monetização esperta, mas grita ‘trava premium’.

Dado concreto: buscas no NotebookLM explodiram 300% após o lançamento, segundo SimilarWeb, passando os Projetos do Claude em ferramentas de pesquisa. O Google aposta que seu ecossistema — Docs, Drive, Gemini — cria fidelidade que Claude e ChatGPT não batem.

E pro profissional médio, qual a real? Se você tá afogado em relatórios, isso corta horas na montagem de decks. Eu? Usaria pra pitches de cliente — transforma análise densa num sizzle reel de 2 minutos.

Minha visão exclusiva, fora da hype: isso lembra a dominação do Maps em 2005. Lembra? A Apple largou o mapa dela pro do Google. Agora, com IA, o Google Maps não é só direção; é seu concierge urbano. A história se repete — espere um salto de 25% no lock-in do Workspace até 2027 conforme devs embedam essas ferramentas.

O Ask Maps é o Nocaute de Navegação do Google?

Google Maps: “maior upgrade em mais de uma década.” Afirmação ousada. Com Gemini por trás, o “Ask Maps” deixa você perguntar como pra um amigo: “Lugar vegano com vaga na rota pro LAX, sem fila.”

Ele decifra a intenção, cruza tráfego, reviews, até mapas de carregadores. Rotas imersivas em 3D? Street View costurado por IA — mashups aéreos mostrando prédios reais, viadutos. Orientação de faixa avisa faixas de pedestre, semáforos com antecedência. Prédios transparentes pra curvas escondidas? Gênio pra ciclistas, Ubers.

Testei no Android: pedi “café quieto com tomada, a menos de 10 min daqui.” Acertou uma joia escondida e explicou por que era melhor que as outras. Lançamento faseado — Android primeiro, iOS na rabeira.

Dinâmica de mercado: Waze (do Google) come 40% do share de navegação nos EUA; Apple Maps tenta recuperar. Isso? Pode empurrar o Maps pra 60% misturando IA conversacional com o fosso de dados geo. Usuários de Claude, fiquem ligados — o modelo de mundo do Gemini esmaga LLMs puramente textuais aqui.

Por Que o Gemini Embedding 2 Muda o RAG pra Sempre

Muda de marcha: Gemini Embedding 2. Fera multimodal — texto (8k tokens), 6 imagens, 120s de vídeo, áudio, PDFs de 6 páginas. Tudo num só espaço vetorial.

Devs, isso é ouro pro RAG. Monte buscas sobre mídias mistas sem transcrever áudio ou fazer OCR em docs. O playground do Google já usa; agora Vertex AI libera.

Nos benchmarks do HuggingFace, ele deixa os embeddings text-only da OpenAI 15% pra trás em recuperação multimodal. Previsão: em 2026, 40% dos novos stacks RAG migram pro Ge