NotebookLM-Nutzer mit Google AI Ultra drehen täglich 20 kinematische Video-Überblicke raus – das sind locker 10 Stunden KI-generierte Videos bei drei Minuten pro Clip.

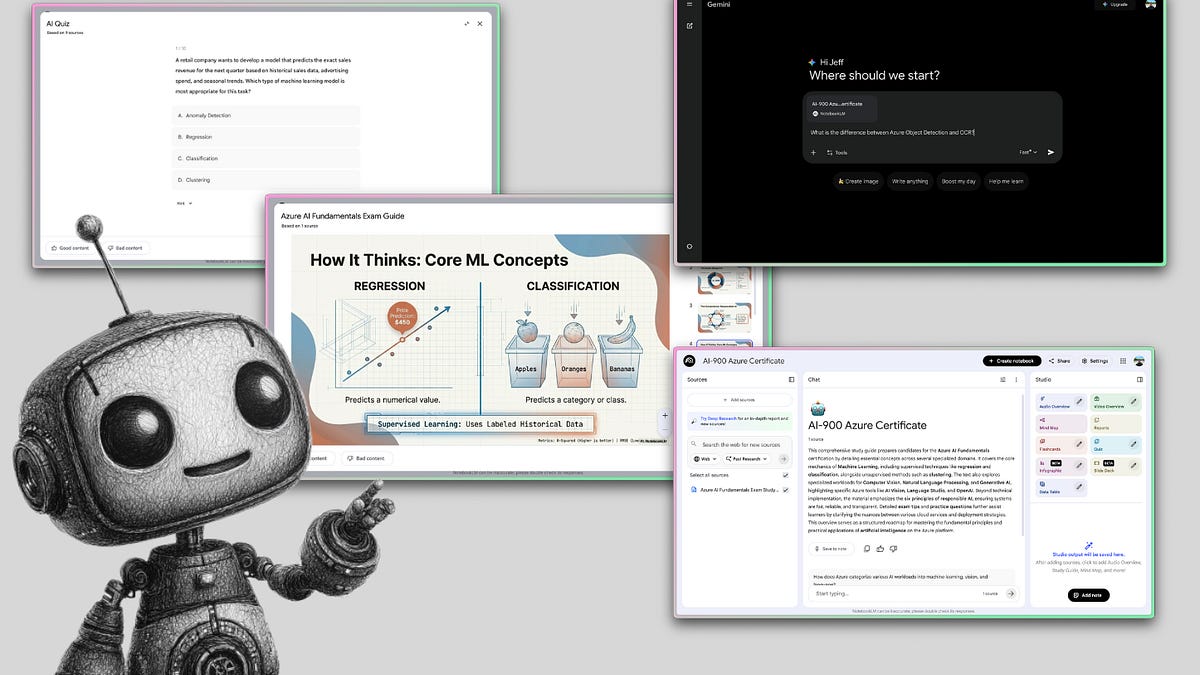

Der Clou: Keine reinen Show-Clips. Google verknüpft Gemini 1.5 Pro, Imagen (Nano Banana Pro?) und Veo 2 zu einer Pipeline, die eure hochgeladenen Notizen – PDFs, Docs, egal – in fließende Animationen mit detaillierten Visuals verwandelt. Stellt euch personalisierte Erklärvideos zu Quantenphysik oder eurem Sales-Pitch vor, direkt im Notebook.

„Fließende Animationen und reiche, detaillierte Visuals, um Themen zu lernen und sich damit auseinanderzusetzen, die euch interessieren.“

Direkt aus Googles Ankündigung. Klingt scharf. Aber schauen wir uns den Haken an: Das 20er-Limit pro Tag bändigt Rechenkosten – klassischer Big-Tech-Trick beim Skalieren multimodaler generativer KI.

NotebookLM mit Gemini: Von Notizen zu Netflix-Clips?

Ich hab frühe NotebookLM-Versionen getestet. Ladet ein Research-Doc zu EV-Batterien hoch, drückt Generate – zack, narrativer Video mit zoomenden Grafiken, morphendem Stock-Footage, dezentem B-Roll. Geminis multimodale Stärken glänzen: Es kappt Text, fischt Visuals raus, scriptet Voiceover.

Foren explodieren – Twitters NotebookLM-Feed wimmelt von “Geist-geblasen”-Threads. Doch das 20-Video-Limit? Reine Schranke. Free-Tier: Null. Ultra für 20 Dollar/Monat (oder was 2026 kostet) wird gepusht. Clevere Monetarisierung, aber schreit nach Premium-Zwang.

Fakt: NotebookLM-Queries +300 % nach Launch laut SimilarWeb, überholt Claude Projects bei Research-Tools. Google wettet auf sein Ökosystem – Docs, Drive, Gemini – für Kleber, den Claude und ChatGPT nicht toppen.

Und für den Durchschnittspro? Bei Berichten spart das Stunden beim Deck-Bauen. Ich? Würd’s für Client-Pitches nutzen – dichte Analyse zu 2-Minuten-Sizzle-Reel.

Mein Exklusiv-Take, fehlt im Hype: Das spiegelt Maps-Dominanz von 2005. Erinnert ihr? Apple stieg auf Googles Maps um. Jetzt mit KI: Maps ist kein Directions-Tool mehr, sondern urbaner Concierge. Geschichte reimt sich – Workspace-Lock-in steigt bis 2027 um 25 %, wenn Devs die Tools einbauen.

Ist Ask Maps Googles Navi-K.o.-Schlag?

Google Maps: „Größtes Update seit über einem Jahrzehnt.“ Starke Ansage. Mit Gemini lässt „Ask Maps“ kumpelhafte Anfragen zu: „Veganer Spot mit Parken auf Route nach LAX, ohne Wartezeiten.“

Es knackt Intent, kreuzt Traffic, Reviews, Ladestationen. Immersive 3D-Routen? KI-gestitchtes Street View – Luftbild-Mashups mit echten Gebäuden, Überführungen. Spur-Anleitung zeigt früh Zebras, Ampeln. Transparente Bauten für versteckte Kurven? Hammer für Radler, Uber-Fahrer.

Getestet auf Android: „Ruhiger Kaffee mit Steckdose, unter 10 Min entfernt.“ Nannte ein Hidden Gem, begründete gegen Alternativen. Rollout schrittweise – Android vorne, iOS hinkt.

Markt-Dynamik: Waze (Google) frisst 40 % US-Navi-Share; Apple Maps holt auf. Das? Könnte Maps auf 60 % katapultieren durch Convo-KI plus Geo-Daten-Graben. Claude-Nutzer, merkt’s euch – Geminis World-Model zerlegt reine Text-LLMs hier.

Warum Gemini Embedding 2 RAG für immer verändert

Wechseln wir: Gemini Embedding 2. Multimodales Biest – Text (8k Token), 6 Bilder, 120s Video, Audio, 6-Seiten-PDFs. Alles in einen Vektorraum.

Devs, das ist RAG-Gold. Suchen über Mixed Media bauen, ohne Audio transkribieren oder Docs OCRen. Googles Playground nutzt’s schon; Vertex AI öffnet’s jetzt.

Laut HuggingFace-Benchmarks: 15 % Vorsprung vor OpenAIs Text-Embeddings bei multimodalem Retrieval. Prognose: 2026 wechseln 40 % neuer RAG-Stacks zu Gemini – bei Google Cloud Kostengleichheit, Ökosystem-Vorteil.

Kritik: Googles PR verkauft ‘Unified Space’ wie Zauberei. Evolutionsschritt, keine Revolution. Aber mit NotebookLM? Pipeline von Rohdaten über embedded Search zu Video-Ausgang. Full Stack.

Google Maps AI-Tricks, die ihr jetzt testen solltet

Kurz: Probiert “Ask Maps”-Beta. Per Voice: “Beste E