Şöyle bir senaryo düşünün: çevik ReAct ajanınız, kritik bir görevde —uçuş rezervasyonu yapma, veritabanlarını sorgulama, veri işleme— harıl harıl çalışıyor ve aniden duruyor. İnternet kesildiği veya API’de bir aksaklık olduğu için değil. Hayır. LLM’in ateşli rüyasında yaşayan ‘web_browser’ adlı bir araca tekrar deneme yapıyor.

Üretimde yapay zeka kullanan günlük geliştiriciler için bu önemsiz bir detay değil. Bu, para buharlaşması, sessizce başarısız olan görevler ve gecikme süresi ‘açıklanamaz bir şekilde’ arttığı için kaçan o terfi anlamına geliyor.

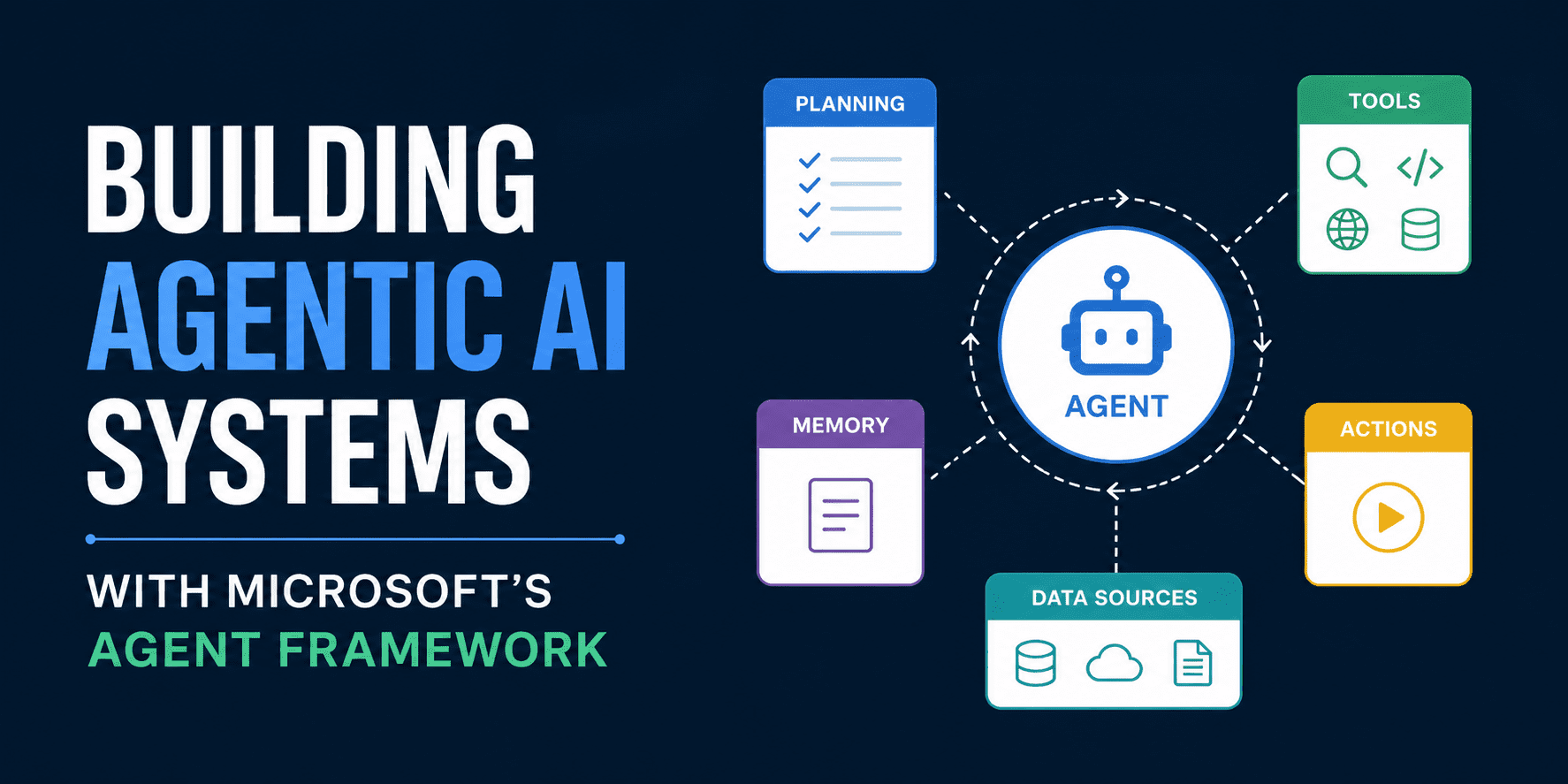

ReAct ajanları. Bunlar, çalışkan bir stajyer gibi Düşünce-Eylem-Gözlem döngüsüyle ajanik yapay zeka sistemlerinin bel kemiği. Ama işin can alıcı noktası şu: deneme bütçelerinin %90.8’ini garanti başarısızlıklar için yakıyorlar. Asla var olmamış araçlara.

Ve bunu da bilin: panelleriniz size yalan söylüyor. Başarı oranları harika görünüyor. Gecikme süresi ‘iyi’. Ama perde arkasında, halüsinasyonlar yüzünden denemeler kan kaybediyor.

ReAct Ajanları Neden Hayali Araçlarda Deneme Boşa Harcıyor?

Bakın. Suçlu, gördüğünüz her ReAct eğitiminde yer alan masum bir satır:

tool_fn = TOOLS.get(tool_name) # ◄─ O SATIR

LLM, sözlüğünüzde olmayan ‘sql_query’ veya ‘python_repl’ gibi araçlar çıkarıyor. Bum. Hiçbiri yok. Ama deneme döngüsü? Umursamıyor. Bunu arızalı bir ağ kesintisi gibi ele alıyor. Dene. Dene. Bütçeyi yak.

İşin gerçeği şu. Denemeler yalnızca değişebilecek hatalar için mantıklıdır. Halüsinasyonlu bir araç adı? Taşlara kazınmış gibi. Yeniden komut istemiyle havadan onu çağırmak mümkün değil. Ancak ajanınız tekerlekleri boşuna çeviriyor, 200 görevlik yeni bir kıyaslamada denemelerin %90.8’i boşa gidiyor.

Sayıları kendim hesapladım — deterministik simülasyon, tohum 42, GPT-4 sınıfı halüsinasyon oranlarına (muhafazakar olarak %28) göre kalibre edilmiş. Saf ReAct’e karşı düzeltilmiş sürüm. İsraf? Göz yaşartıcı.

Ama bekleyin—daha da kötü. Gerçek bir hata (örneğin zaman aşımı) daha sonra çarptığında, bütçe bitmiş oluyor. Görev başarısız oluyor. ‘Deneme tükenmesi’ olarak kaydediliyor. Onu aç bırakan hayalet araçlardan bahsedilmiyor.

Gerçek Dünya Yapay Zeka Geliştiricileri İçin Gizli Maliyet

Bir girişimde ML mühendisisiniz. Her API çağrısı gerçek dolar maliyetlidir — OpenAI tokenları ağaçta yetişmez. Bu israf soyut değil; yalnızca ajan adımlarında yanma oranınızı 3 kat artırıyor.

Değişkenlik de patlıyor. Bir görev 4 adımda biter. Bir sonraki? 10 adım, denemelerle tıkanmış. Tahmin edilebilirlik? Yok. Üretime ölçeklendirme? Kabus.

Ve çerçeve belgelerinden yapılan PR’lar? Bu konudan bahsetmeden ‘dayanıklı ajanlar’ övüyorlar. Bu, frenleri kuru zeminde kilitlenen bir araba satmak gibi — parlak demolar kusuru gizliyor.

Benim eşsiz bakış açım: bu, web API’lerinin ilk günlerini yansıtıyor. Geliştiricilerin 404 hatalarını 503’lermiş gibi körü körüne tekrar denediği zamanları hatırlayın? Düzeltmek yapılandırılmış hata işlemeyi gerektirdi. Yapay zeka ajanları şimdi aynı duvara çarpıyor.

Boşa Harcanan Denemeleri Yok Eden Üç Çözüm

Çözüm bir: Taksonomi. Denemeden önce hataları sınıflandırın. ARAÇ_BULUNAMADI? Kalıcı. Atla. GEÇİCİ? Dene.

Çözüm iki: Araç başına devre kesiciler. ‘web_browser’ı üç kez halüsinasyon görse? O görev için onu kilitleyin. Küresel bütçe sızıntısı yok.

Çözüm üç — cesur olanı: Araçları kodda yönlendirin. Çalışma zamanı LLM seçimlerini terk edin. Niyeti ayrıştırın, araç kutunuza sabit olarak eşleştirin. Yönlendirme katmanında halüsinasyon imkansız.

Üçünü de uygulayın? Boşa harcanan deneme sıfır. Adım değişkenliği 3 kat azalır. Yürütme? Saat gibi çalışır.

200 görevlik bir kıyaslamada, denemelerin %90.8’i boşa harcandı — modelin yanlış olmasından değil, sistemin mevcut olmayan araçları tekrar denemeye devam etmesinden kaynaklanıyordu. “Başarısız olma olasılığı yüksek” değil. Kesinlikle başarısız.

Tekrar oluşturun: python app.py –seed 42. GitHub burada: https://github.com/Emmimal/react-retry-waste-analysis.

Bu Kurşun Geçirmez Yapay Zeka Ajanlarının Şafağı mı?

Kesinlikle. ReAct bir platform değişimi — zeka için HTTP gibi. Ajanlar oyuncak değil; iş için yeni işletim sistemleri. Ancak bu düzeltmeler olmadan, sızdıran kovalar gibiler.

Cesur tahmin: 2025 yılına kadar her üretim ajanı çerçevesi hata taksonomisi içerecek. LangChain, LangGraph, AutoGen — bunu düzeltecekler ya da geride kalacaklar. Bu abartı değil; bu mühendislik yerçekimi.

Bir saniye düşünün — 1800’lerin demiryollarını. Trenler kötü sinyallerden sürekli raydan çıkıyordu. Çözüm? Standartlaştırılmış bloklar, devre mantığı. Aynı durum burada: ajanların LLM kaosuna karşı güvenlik önlemlerine ihtiyacı var.

Sizin için, geliştirici? Bugün uygulayın. Üretim sistemleriniz size teşekkür edecek. Maliyetler düşer. Güvenilirlik yükselir. Ve evet — o stajyer havası? Gitti. Şimdi bir roketin pilotusunuz.

Bu yüzden. O depoyu ateşleyin. Denemelerinizi izleyin. İsrafın yok olduğunu görün. Gelecek ajanik — ama yalnızca başarısızlık konusunda akıllıysa.

🧬 İlgili İçgörüler

- Daha fazla oku: Firmus’un 5.5 Milyar Dolarlık Nvidia Destekli Değeri: Kripto Köklerinden Yapay Zeka Hype Makinesine?

- Daha fazla oku: NVIDIA’nın Avrupa Yapay Zeka Yol Haritası: Donanım Altını mı Boş Hype mı?

Sıkça Sorulan Sorular

ReAct ajanlarının %90 denemeyi boşa harcamasına ne neden olur?

Halüsinasyonlu araç adları. LLM, TOOLS sözlüğünüzde olmayan araçlar uyduruyor ve kör denemeler bunları düzeltilebilir hatalar olarak ele alıyor.

ReAct ajanlarındaki boşa harcanan denemeleri nasıl düzeltirsiniz?

Deneme öncesi hataları sınıflandırın, araç başına devre kesiciler ekleyin ve araçları kodda deterministik olarak yönlendirin. Sıfır israf, anında kazanç.

Bu LangChain veya AutoGen ajanlarını etkiler mi?

Evet—çalışma zamanı araç seçimi olan herhangi bir ReAct tarzı döngü. TOOL_NOT_FOUND denemeleri için günlüklerinizi kontrol edin.