過去10年間のAIアプリケーションの主流は、クラウド中心のアプローチだった。エッジで収集されたデータは、遠隔地のデータセンターにある強力なサーバーに送信され、大規模モデルで処理された後、結果が返ってくる。この方式は、レイテンシが許容範囲内であり、接続性が安定していて、データプライバシーが最優先事項でない場合には有効だった。しかし、現実世界のアプリケーションの増加に伴い、これらの前提条件が通用しないケースが増えている。そこで登場したのが、機械学習モデルをローカルデバイス上で直接実行する「Edge AI」だ。

Edge AIとは?

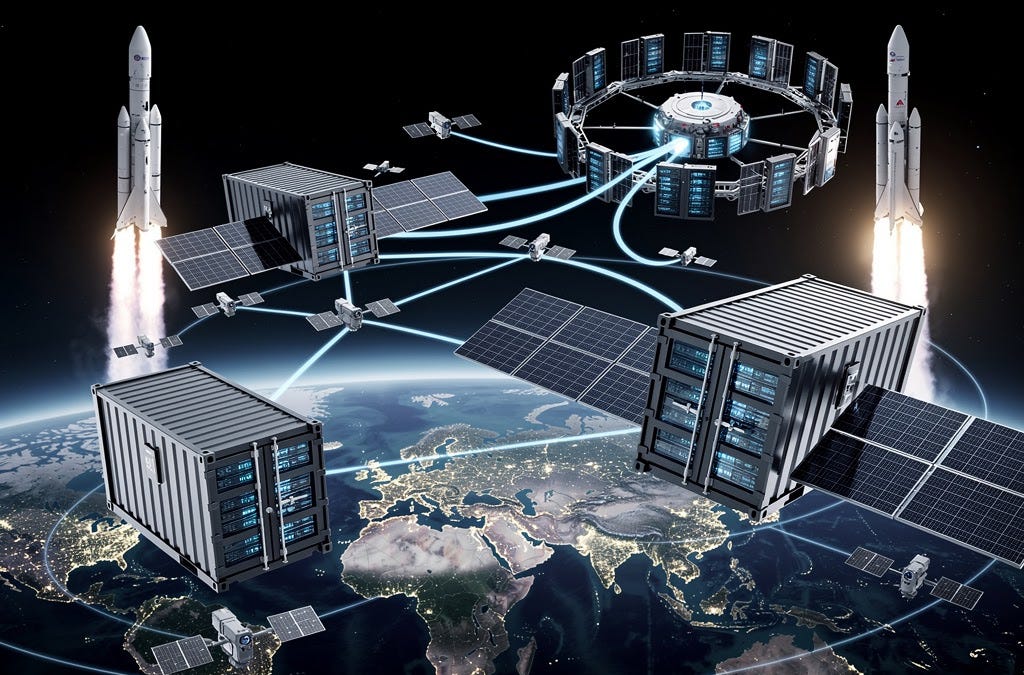

Edge AIとは、AIアルゴリズムを、集中管理されたクラウドサーバーではなく、ネットワークの末端にあるハードウェアデバイス上で展開・実行することだ。「エッジ」とは、スマートフォン、セキュリティカメラ、工場のセンサー、自動運転車、医療機器、あるいはデータが生成されるまさにその場所で動作するあらゆるコンピューティングデバイスを指す。

AIがエッジで実行される場合、データはクラウドとの往復通信なしにローカルで処理される。この計算場所の根本的なシフトにより、リアルタイム応答が求められるアプリケーション、接続環境が制限されている環境で動作するアプリケーション、あるいはネットワーク経由での送信には機密性が高すぎるデータを扱うアプリケーションといった、新たなカテゴリーが生まれる。

なぜAIをエッジへ移行するのか?

レイテンシの削減

クラウドベースのAI推論では、データ転送、ネットワークの混雑、サーバーのキューイングタイムによるレイテンシが発生する。自動運転、産業安全システム、AR(拡張現実)といったアプリケーションでは、たとえ数ミリ秒の遅延でも許容できない場合がある。Edge AIはネットワークレイテンシを完全に排除し、数ミリ秒単位での推論を可能にする。自動運転車は、道路上の物体が歩行者か影かを判断するために、クラウドサーバーの応答を待つわけにはいかない。

プライバシーとデータ主権

Edge AIでは、機密データは生成されたデバイス上に保持される。医療画像データは、病院の外に出ることなく分析できる。顔認識は、生体データがネットワークを通過することなくスマートフォン上で動作する。音声アシスタントは、会話の記録をクラウドサーバーに送信することなく、ローカルでコマンドを処理できる。このアーキテクチャは、GDPRのようなデータ保護規制の強化とも整合し、ユーザーに個人情報に対するより大きなコントロール権を与える。

帯域幅とコスト効率

生のセンサーデータをクラウドに転送するのは、高コストで帯域幅を大量に消費する。1台の自動運転車は、1日にテラバイト級のセンサーデータを生成する。数百のIoTセンサーを備えた工場フロアでは、高ボリュームのデータストリームが継続的に発生する。これらのデータをローカルで処理し、実行可能なインサイトのみを送信することで、帯域幅の要件とクラウドコンピューティングのコストを劇的に削減できる。

信頼性とオフライン運用

クラウド依存のAIシステムは、接続が失われると機能しなくなる。Edge AIは、ネットワークの状態に関わらず動作し続ける。これは、遠隔地、軍事環境、航空機、船舶、あるいは接続が断続的または利用不可能なあらゆるシナリオでのアプリケーションにとって極めて重要だ。

Edge AIの主要ハードウェア

ニューラルプロセッシングユニット(NPU)

最新のスマートフォンやラップトップには、専用のニューラルプロセッシングユニット、すなわちニューラルネットワーク推論で支配的な行列演算のために特別に設計されたシリコンが搭載されることが増えている。AppleのNeural Engine、QualcommのAI Engine、Googleのモバイル向けTensor Processing Unitなどは、AIワークロードにおいて、汎用CPUよりも大幅なパフォーマンス向上をもたらす一方、消費電力ははるかに少ない。

Edge AIアクセラレータ

専用のEdge AIハードウェアには、ロボティクスやIoT向けのNVIDIA Jetsonプラットフォーム、組み込みビジョンアプリケーション向けのGoogle Coral Edge TPU、エッジでのコンピュータビジョン向けのIntel Movidius VPUなどがある。これらのデバイスは、リソースが制約された環境で高度なAIを実用的にするために、パフォーマンス、電力効率、コストのバランスを提供している。

FPGAおよびカスタムASIC

特定のパフォーマンス要件を持つ高ボリュームアプリケーションでは、FPGA(Field-Programmable Gate Array)やカスタムASIC(Application-Specific Integrated Circuit)が、最適化された推論パフォーマンスを提供する。開発コストは高いが、これらのソリューションは固定ワークロードに対して最高の効率を提供し、ネットワーク機器、自動車システム、産業用コントローラーなどのアプリケーションに理想的だ。

Edgeデプロイメントのためのソフトウェアフレームワーク

エッジデバイスへのAIモデルのデプロイには、リソースが制約されたハードウェア向けにモデルを最適化する、特殊なソフトウェアフレームワークが必要となる。TensorFlow LiteやONNX Runtimeは、モバイルおよび組み込みデバイス向けのモデル変換と最適化を提供する。PyTorch Mobileは、PyTorchエコシステムをエッジデプロイメントに拡張する。Apache TVMは、多様なハードウェアターゲット向けに最適化されたコードへとモデルをコンパイルする。NVIDIA TensorRTは、クラウドおよびエッジ全体にわたるNVIDIAハードウェア向けに推論を最適化する。

これらのフレームワークは、モデルの量子化(数値精度を32ビットから8ビット以下に削減)、プルーニング(不要なネットワーク接続の除去)、知識蒸留(より大きなモデルを模倣するように小さなモデルをトレーニング)などの技術を用いて、精度を維持しながらモデルを縮小する。

Edgeデプロイメントのためのモデル最適化

量子化

量子化は、モデルの重みとアクティベーションの精度を32ビット浮動小数点から8ビット整数、あるいはそれ以下に削減する。これにより、ほとんどの精度を維持しながら、モデルサイズを4分の1以下に削減できる。Post-training quantizationは再トレーニングを必要とせず既存モデルに適用可能だが、Quantization-aware trainingはトレーニング中に低精度を組み込むことで、より高い精度を実現する。

プルーニングと圧縮

ニューラルネットワークのプルーニングは、モデルの精度への貢献が最小限の重みやニューロン全体を除去する。Structured pruningは、チャンネルやレイヤー全体を除去し、直接的に小さく高速なモデルを生成する。重み共有などの圧縮技術と組み合わせることで、プルーニングは精度の低下を最小限に抑えつつ、モデルサイズを10分の1以上に削減できる。

アーキテクチャ設計

一部のモデルアーキテクチャは、最初からエッジデプロイメントのために設計されている。MobileNet、EfficientNet、SqueezeNetなどは、depthwise separable convolutionsやinverted residualsといったアーキテクチャ上の革新を利用し、標準的なアーキテクチャよりもはるかに少ないパラメータで高いパフォーマンスを実現している。

各産業における応用例

Edge AIは、すでに多くの分野で活用されている。製造業では、生産ラインのビジョンシステムが、クラウドに依存せずにリアルタイムで欠陥を検出する。ヘルスケアでは、ポータブル診断デバイスが、ケアの現場で医療画像を分析する。農業では、オンボードAIを搭載したドローンが、作物病を特定し、灌漑を最適化する。小売業では、スマートカメラが、ビデオをクラウドに送信することなく、人の流れや棚の在庫を分析する。自動車産業では、高度運転支援システム(ADAS)が、センサーデータをローカルで処理し、一瞬の安全判断を下す。

課題とトレードオフ

Edge AIには、現実的なトレードオフが伴う。最適化により、モデルの精度が低下することが多い――小さく高速なモデルは、通常、クラウドベースのモデルよりも能力が劣る。ハードウェアの制約は、エッジで実行できるモデルの複雑さを制限する。数千、数百万ものデバイスに展開されたモデルの更新は、重大な運用上の課題を提示する。消費電力、熱管理、物理的な耐久性も、エンジニアリングの複雑さを増す。

これらの課題にもかかわらず、AI推論はデータ生成場所へと近づくという方向性は明確だ。エッジハードウェアがより強力になり、最適化技術が向上するにつれて、クラウドAIとエッジAIの能力のギャップは縮まり続け、インテリジェントで応答性が高く、プライベートなアプリケーションの広大な宇宙を可能にしていくだろう。