Et si scaler l’IA indéfiniment réclamait non pas des puces plus grosses, mais des centrales électriques en orbite pompant un soleil infini ?

C’est la question qui rode sous chaque prévision gonflée à bloc sur le prochain modèle. Et oui, scaler l’IA est royalement sous-estimé — non pas faute de calcul, mais d’énergie. Du jus pur et dur.

Regardez. Les hyperscalers déversent des trillions dans des datacenters qui engloutissent l’énergie comme des 747 au décollage. Mais les réseaux ? Ils suffoquent. Centrales à charbon relancées, gaz naturel qui flambe, promesses nucléaires à des décennies.

Le buzz de ce week-end autour de la dernière transcription d’Elon Musk a tout cristallisé. SpaceX, ce n’est pas que des fusées ; c’est la clé pour débloquer le goulot d’étranglement de l’IA.

Quand SpaceX fera son introduction en bourse en 2026 (dès juin peut-être), la promesse de l’avenir ne portera pas seulement sur les datacenters, mais sur la captation d’une énergie solaire bien plus abondante pour alimenter l’IA à une échelle impossible aujourd’hui avec les contraintes du réseau électrique américain.

Voilà le déclencheur. Boum.

Pourquoi scaler l’IA nous oblige-t-il à repenser l’espace ?

Réponse courte : les maths. Entraîner des équivalents de GPT-5 ? Ça parle en gigawatts. Un seul modèle de pointe avale l’électricité d’une petite ville par an. Multipliez par des dizaines — OpenAI, Anthropic, xAI — et les réseaux plient.

Mais le fond du problème, c’est autre chose. Les datacenters actuels plafonnent à 50-60 % d’efficacité, avec des pertes massives en chaleur et en transmission. Le refroidissement seul ? Un cauchemar. Ajoutez des capex qui explosent à 1 000 milliards de dollars d’ici 2027, et c’est clair : les rustines terrestres réparent, elles ne scalent pas.

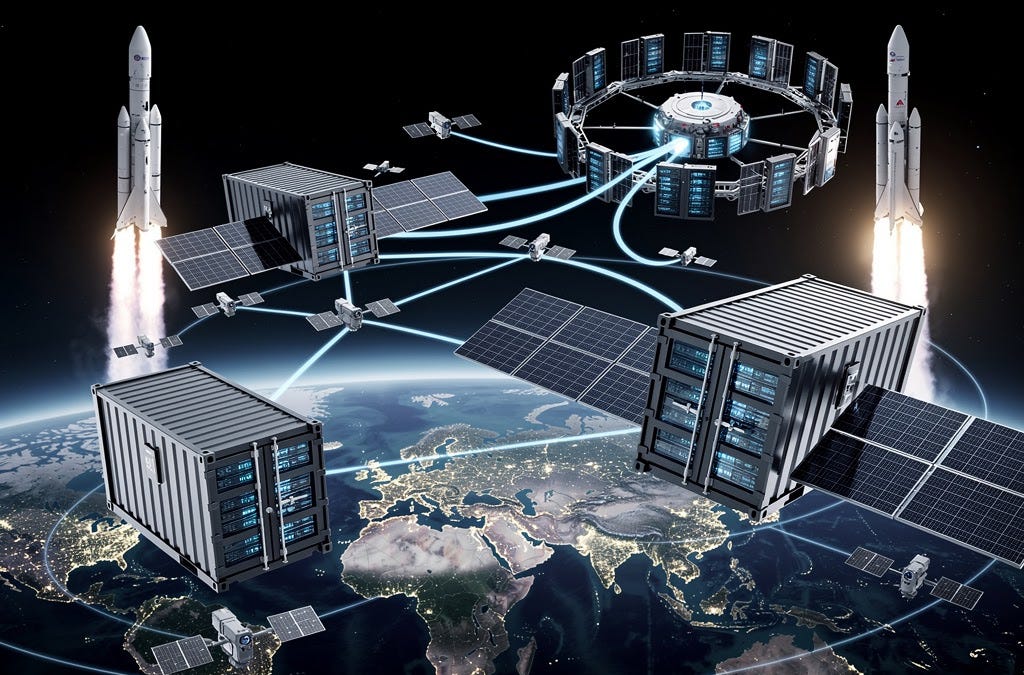

L’espace entre en scène. Zéro atmosphère, refroidissement radiatif parfait — sans ventilateurs, sans eau. Soleil 24 h/24, sans nuages ni nuit. Transmettre l’énergie par micro-ondes ou lasers vers des datacenters hybrides Terre-orbite. D’un coup, l’énergie n’est plus un coût ; elle est abondante.

Et la fabrication ? Régolithe lunaire pour des plaquettes de silicium, cristaux en apesanteur plus purs que tout ce que la Terre produit. Fusées ? Des Falcons réutilisables qui font chuter le lancement à presque rien au kilo.

Sceptique ? Légitime. Mais 75 ans après que Clarke et Asimov rêvaient d’orbites futuristes, la tech est mûre. Prototypes Starship qui s’empilent, ravitaillement orbital testé. Ce n’est plus de la science-fiction ; c’est de l’ingénierie.

Une analogie percutante que mes recherches ont dénichée : rappelez-vous les chemins de fer du XIXe siècle. Ils ne transportaient pas que des marchandises — ils redéfinissaient l’échelle industrielle, en acheminant charbon et fer depuis les confins. Le stack de SpaceX ? Des chemins de fer pour le calcul, en minant le solaire depuis l’orbite, pour livrer la suprématie IA. Le vrai basculement : pas des puces incrémentales, mais des rails infrastructurels vers l’infini.

L’introduction en bourse de SpaceX va-t-elle déclencher l’IA orbitale ?

Tout pour ça. La vision de Musk fusionne xAI sous le parapluie SpaceX — une bête de calcul en filiale. Déluge de cash après l’IPO ? Des milliards pour Starlink 2.0, mais version orbitale tordue : datacenters ronronnant dans le vide.

Imaginez : OpenAI qui hyperscale sur Azure, Anthropic sur AWS, mais xAI ? Un nuage planétaire depuis l’orbite basse. Avantage absurde si le calcul reste roi (et il le sera, jusqu’à ce que les architectures basculent).

Critiquez le battage, quand même. Les délais de Musk ? Célèbres pour leur élasticité — réutilisation totale de Starship prévue en ’22, maintenant vers ’25. Pourtant, les preuves s’accumulent : plus de 100 lancements en 2024, usines de propergol qui montent en cadence. Fin des années 2020, bases lunaires banalisées ? Mon pronostic audacieux : premier pod IA orbital testé en direct en 2028, production en 2030. Du hype ? Bien sûr. Sous-estimé ? Absolument.

Les datace